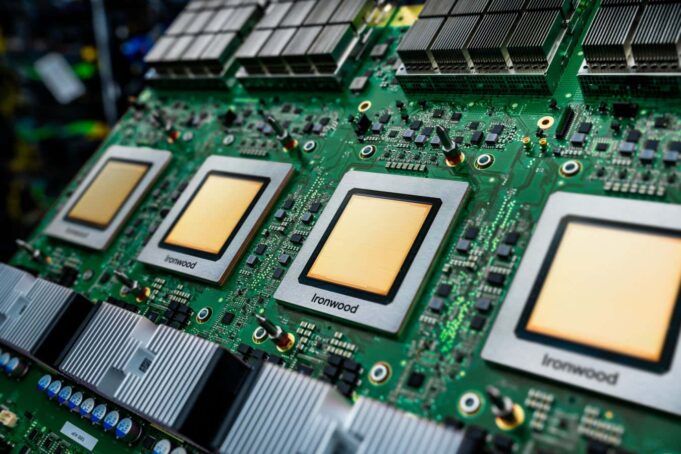

Ironwood è l’ultima unità di elaborazione tensore di Google

La posizione di Nvidia come principale fornitore di chip AI potrebbe essere minacciata da un chip specializzato introdotto da Google, suggerisce il rapporto delle società come meta E antropico Google sta cercando di spendere miliardi in unità di elaborazione tensore.

Cos’è il TPU?

Il successo dell’industria dell’intelligenza artificiale si basa in gran parte sulle unità di elaborazione grafica (GPU), un tipo di chip di computer in grado di eseguire più calcoli in parallelo allo stesso tempo anziché uno dopo l’altro come le unità di elaborazione del computer (CPU) che alimentano la maggior parte dei computer.

Le GPU sono state originariamente sviluppate per supportare la computer grafica, come suggerisce il nome, e i giochi. “Se ho molti pixel in una posizione e devo ruotarla per calcolare una nuova vista della telecamera, è un’operazione che può essere eseguita in parallelo per molti pixel diversi”, afferma. Francesco Conti Presso l’Università di Bologna in Italia.

Questa capacità di eseguire calcoli in parallelo si è rivelata utile per l’addestramento e l’esecuzione di modelli di intelligenza artificiale, che spesso utilizzano calcoli che coinvolgono enormi griglie di numeri eseguiti contemporaneamente, chiamati moltiplicazione di matrici. “Le GPU sono un’architettura molto generale, ma sono estremamente adatte per applicazioni che mostrano un elevato livello di parallelismo”, afferma Conti.

Tuttavia, poiché non sono state originariamente progettate pensando all’intelligenza artificiale, potrebbero esserci inefficienze nel modo in cui le GPU traducono i calcoli eseguiti sui chip. Conti afferma che le unità di elaborazione tensore (TPU), originariamente sviluppate da Google nel 2016, sono progettate interamente attorno alla moltiplicazione di matrici, che sono i calcoli fondamentali necessari per addestrare ed eseguire modelli di intelligenza artificiale di grandi dimensioni.

Quest’anno, Google ha rilasciato La settima generazione del suo TPU, chiamata IronwoodChe alimenta molti dei modelli di intelligenza artificiale dell’azienda come Gemini e AlphaFold per la modellazione delle proteine.

I TPU sono migliori delle GPU per l’intelligenza artificiale?

Tecnicamente, ad esempio, il TPU è un sottoinsieme della GPU piuttosto che un chip completamente separato Simon McIntosh-Smith Università di Bristol, Regno Unito. “Si concentrano sulle attività svolte dalle GPU specificatamente allo scopo di addestramento e inferenza per l’intelligenza artificiale, ma in realtà sono in qualche modo più simili alle GPU di quanto si possa pensare.” Ma poiché i TPU sono progettati pensando a determinate applicazioni di intelligenza artificiale, potrebbero essere più efficienti per questi lavori e potenzialmente far risparmiare decine o centinaia di milioni di dollari, afferma.

Tuttavia, questa specializzazione ha anche i suoi svantaggi e potrebbe rendere la TPU inflessibile se i modelli di intelligenza artificiale cambiassero in modo significativo tra le generazioni, afferma Conti. “Se non disponi di elasticità (TPU), devi eseguire (calcoli) sulla CPU del tuo nodo nel data center e questo ti rallenterà enormemente”, afferma Conti.

Un vantaggio tradizionalmente offerto dalle GPU Nvidia è che è disponibile un semplice software che può aiutare i progettisti di intelligenza artificiale a eseguire il proprio codice sui chip Nvidia. Conti dice che quando i TPU sono nati per la prima volta non esistevano allo stesso modo, ma i chip sono ora in una fase in cui sono più semplici da usare. “Con il TPU ora puoi fare le stesse cose (delle GPU)”, afferma. “Ora che l’hai abilitato, è chiaro che la disponibilità è diventata un fattore importante.”

Chi produce TPU?

Sebbene Google sia stata la prima a lanciare una TPU, molte delle più grandi aziende di intelligenza artificiale (note come hyperscaler) e start-up più piccole hanno ora iniziato a sviluppare le proprie TPU specializzate, tra cui Amazon, che utilizza i propri chip Trennium per addestrare i suoi modelli di intelligenza artificiale.

“La maggior parte degli hyperscaler ha i propri programmi interni, e questo è in parte il motivo per cui le GPU sono diventate così costose perché la domanda supera l’offerta e può essere più economico progettare e costruire i propri”, afferma McIntosh-Smith.

Che impatto avrà il TPU sul settore dell’intelligenza artificiale?

Google sviluppa i propri TPU da oltre un decennio, ma utilizza principalmente questi chip per i suoi modelli AI. Ciò che sembra cambiare ora è che altre grandi aziende come Meta e Anthropic stanno acquistando grandi quantità di potenza di calcolo dalle TPU di Google. “Non abbiamo sentito parlare di grandi clienti che cambiano, e probabilmente questo sta iniziando ad accadere ora”, dice McIntosh-Smith. “Sono maturati molto e ce ne sono molti.”

Secondo lui, pur creando più opzioni per le aziende più grandi, potrebbe essere logico per loro diversificare dal punto di vista finanziario. “Potrebbe anche darsi che questo significhi che in futuro otterrete un accordo migliore da Nvidia”, dice.

Soggetto: