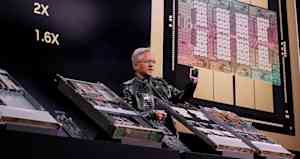

Annunciato al CES 2026, Nvidia Vera Rubin NVL72 crittografa 72 GPU, 36 CPU e ogni percorso dati sull’intero tessuto NVLink. È la prima piattaforma su scala rack a fornire elaborazione riservata su domini CPU, GPU e NVLink.

Per i leader della sicurezza, questo cambia radicalmente la conversazione. Invece di cercare di proteggere complesse configurazioni di cloud ibrido attraverso la fiducia contrattuale con i fornitori di cloud, possono verificarle crittograficamente. Questa è una distinzione fondamentale che conta quando gli avversari-stato-nazione dimostrano di poter lanciare attacchi informatici mirati alla velocità della macchina.

La brutale economia dell’IA vulnerabile

Ricerca epocale sull’intelligenza artificiale La frontiera mostra che i costi dell’istruzione sono aumentati di 2,4 volte all’anno dal 2016, il che significa che gli sforzi educativi da miliardi di dollari potrebbero diventare realtà entro pochi anni. Ma l’infrastruttura che protegge questi investimenti rimane fondamentalmente insicura nella maggior parte delle implementazioni. I budget per la sicurezza creati per mantenere i modelli di formazione alle frontiere non possono tenere il passo con il ritmo straordinariamente veloce della formazione dei modelli. Di conseguenza, un numero maggiore di modelli è a rischio poiché gli approcci esistenti non riescono a adattarsi e a tenere il passo con la maestria dei concorrenti.

Rapporto IBM sul costo della violazione dei dati per il 2025 È emerso che il 13% delle organizzazioni ha subito violazioni nei propri modelli o applicazioni di intelligenza artificiale. Il 97% delle persone violate non disponeva di adeguati controlli di accesso tramite intelligenza artificiale.

Gli incidenti legati all’IA ombra costano in media 4,63 milioni di dollari, ovvero 670.000 dollari in più rispetto alle violazioni standard; Una violazione su cinque coinvolge ora mezzi non approvati che espongono in modo sproporzionato le informazioni personali dei clienti (65%) e i diritti di proprietà intellettuale (40%).

Considera cosa significa questo per le organizzazioni che spendono 50 o 500 milioni di dollari in attività di formazione. I pesi dei modelli esistono in ambienti multi-tenant in cui i fornitori di servizi cloud possono esaminare i dati. Crittografia a livello hardware che dimostra che l’ambiente non è stato completamente alterato dai cambiamenti nell’equazione finanziaria.

Sveglia GTG-1002

Nel novembre 2025, Anthropic ha rivelato una cosa senza precedenti: un gruppo cinese sostenuto dallo stato, soprannominato GTG-1002, aveva manipolato il Codice Claude per eseguire quello che la società ha descritto come il primo caso documentato di un attacco informatico su larga scala effettuato senza un significativo intervento umano.

Gli avversari sponsorizzati dallo stato lo hanno trasformato in uno strumento di intrusione autonomo che scopre vulnerabilità, sfrutta exploit, raccoglie credenziali, si muove orizzontalmente attraverso le reti e classifica i dati rubati in base al valore di intelligence. Gli operatori umani sono stati schierati solo negli incroci critici. Secondo l’analisi di Anthropic, l’intelligenza artificiale ha eseguito in modo indipendente circa l’80-90% di tutto il lavoro tattico.

Gli effetti si estendono oltre questo singolo evento. Le superfici di attacco che un tempo richiedevano squadre di aggressori esperti possono ora essere esaminate alla velocità della macchina dagli avversari con accesso ai modelli sottostanti.

Confronto tra le prestazioni di Blackwell e Rubin

|

Specifica |

Blackwell GB300NVL72 |

RubinNVL72 |

|

Calcolo inferenziale (FP4) |

1,44 exFLOPS |

3.6 exFLOPS |

|

NVFP4 per GPU (inferenza) |

20 PFLOP |

50 PFLOP |

|

Larghezza di banda NVLink per GPU |

1,8 TB/sec |

3,6 TB/s |

|

Larghezza di banda del rack NVLink |

130 TB/s |

260 TB/s |

|

Larghezza di banda HBM per GPU |

~8 TB/sec |

~22TB/s |

Lo slancio del settore e l’alternativa ad AMD

Nvidia non funziona da sola. Ricerca del Confidential Computing Consortium e IDCIl rapporto, pubblicato a dicembre, ha rilevato che il 75% delle organizzazioni ha adottato il computing riservato, il 18% è già in produzione e il 57% sta conducendo implementazioni pilota.

"Il Confidential Computing si è evoluto da un concetto di nicchia a una strategia vitale per la sicurezza dei dati e l’innovazione affidabile dell’intelligenza artificiale." ha affermato Nelly Porter, direttore esecutivo del Secret Computing Consortium. Rimangono delle vere barriere: le sfide legate alla verifica del consenso influiscono sull’84% dei partecipanti e il divario di competenze ostacola il 75%.

Lo scaffale Helios di AMD adotta un approccio diverso. Basato sulla specifica Open Rack Wide di Meta annunciata all’OCP Global Summit nell’ottobre 2025, offre circa 2,9 exaflop di elaborazione FP4 con 31 TB di memoria HBM4 e 1,4 PB/s di larghezza di banda totale. Laddove Nvidia sta progettando l’elaborazione riservata in ogni componente, AMD sta dando priorità agli standard aperti attraverso il consorzio Ultra Accelerator Link e Ultra Ethernet.

La competizione tra Nvidia e AMD offre ai leader della sicurezza più opzioni di quelle che altrimenti avrebbero. È importante valutare i compromessi tra l’approccio integrato di Nvidia e la flessibilità dello standard aperto di AMD per infrastrutture specifiche e modelli di minaccia specifici dell’azienda.

Cosa stanno facendo ora i leader della sicurezza?

La privacy a livello hardware non sostituisce i principi Zero Trust; Dà loro i denti. Ciò che Nvidia e AMD hanno sviluppato consente ai leader della sicurezza di verificare crittograficamente la fiducia anziché assumerla contrattualmente.

Si tratta di un cambiamento significativo per chiunque esegua carichi di lavoro sensibili su un’infrastruttura condivisa. E se le richieste di verifica persistono nella produzione, questo approccio potrebbe consentire alle organizzazioni di estendere l’applicazione dello zero trust a migliaia di nodi senza la propagazione delle policy e il peso degli intermediari richiesti dalle applicazioni esclusivamente software.

Prima della distribuzione: Verifica l’autenticazione per verificare che gli ambienti non siano stati manomessi. La prova della conformità crittografica dovrebbe essere un prerequisito per la firma dei contratti; non è un ripensamento o, peggio, un piacere da avere. Se il tuo fornitore di servizi cloud non è in grado di dimostrare le capacità di verifica, questa è una domanda che vale la pena porre al prossimo QBR.

Durante l’operazione: Mantieni zone separate per la formazione e l’inferenza e includi i team di sicurezza nella linea del modello fin dall’inizio. La ricerca di IBM ha mostrato che il 63% delle organizzazioni violate non disponeva di politiche di governance dell’IA. Non è possibile garantire la sicurezza dopo lo sviluppo; Ciò significa un percorso verso progetti di sicurezza mediocri e un lungo lavoro di red teaming che individua i bug che devono essere rimossi in anticipo da un modello o da un’applicazione.

A livello di organizzazione: Conduci esercitazioni congiunte tra i team di sicurezza e di scienza dei dati per scoprire le vulnerabilità prima che gli aggressori le trovino. L’intelligenza artificiale ombra è stata responsabile del 20% delle violazioni e ha esposto le PII e l’IP dei clienti a tassi più elevati rispetto ad altri tipi di violazioni.

Insomma

La campagna GTG-1002 ha dimostrato che gli avversari possono ora automatizzare intrusioni su larga scala con una supervisione umana minima. Quasi tutte le organizzazioni che hanno subito una violazione correlata all’intelligenza artificiale non disponevano di controlli di accesso adeguati.

Vera Rubin NVL72 di Nvidia trasforma i rack da potenziali passività in risorse convalidate crittograficamente crittografando ogni percorso di dati. Helios di AMD offre un’alternativa agli standard aperti. La sola azione furtiva dell’hardware non può fermare un nemico determinato; Ma la crittografia su scala rack combinata con una governance forte e un’applicazione realistica delle minacce offre ai leader della sicurezza le basi di cui hanno bisogno per proteggere investimenti misurati in centinaia di milioni di dollari.

La domanda che devono affrontare i CISO non è se valga la pena di utilizzare un’infrastruttura validata. Ciò che conta è se le organizzazioni che sviluppano modelli di IA di alto valore possono permettersi di operare senza di essi.