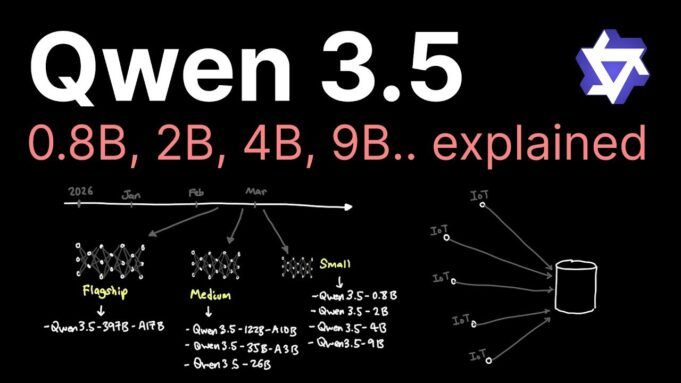

La serie Quen 3.5 di Alibaba rappresenta un entusiasmante cambiamento nello sviluppo dell’intelligenza artificiale concentrandosi su modelli piccoli ed efficienti ottimizzati per dispositivi edge. Come esposto dal codice di Caleb Wright, questi modelli vanno da 800 milioni a 9 miliardi di parametri, fornendo un equilibrio tra compattezza e prestazioni. Ad esempio, la variante da 800 milioni di parametri è adattata per applicazioni leggere come i dispositivi IoT, mentre il modello da 9 miliardi di parametri eccelle in compiti complessi, rivaleggiando con sistemi più grandi in benchmark come MMLU. Questo approccio dà priorità al calcolo locale, aumenta la privacy e consente la funzionalità offline, il che è particolarmente vantaggioso per l’hardware di livello consumer e gli ambienti con risorse limitate.

In questa panoramica imparerai come Queue 3.5 raggiunge prestazioni elevate attraverso innovazioni come sofisticate tecniche di formazione e architettura avanzata. I risultati principali includono i vantaggi pratici derivanti dall’implementazione di questi modelli nell’ecosistema IoT, come l’analisi dei dati in tempo reale e il rilevamento delle anomalie e la loro adattabilità a diversi casi d’uso che vanno dagli smartphone alle applicazioni industriali. Che tu sia interessato all’intelligenza artificiale incentrata sulla privacy o a soluzioni scalabili per l’edge computing, questa analisi fornisce informazioni su come i modelli più piccoli possono soddisfare le crescenti esigenze delle moderne implementazioni di intelligenza artificiale.

Modello piccolo Quen 3.5 di Alibaba, ampia applicazione

TL;DR Fatti principali:

- Il modello AI Quon 3.5 di Alibaba dà priorità a progetti piccoli ed efficienti (parametri da 800M a 9B) per dispositivi edge, sfidando la tendenza del settore dei sistemi centralizzati su larga scala.

- I modelli abilitano funzionalità offline, migliorano la privacy e supportano diverse applicazioni che vanno dai dispositivi IoT all’elaborazione ad alte prestazioni.

- Innovazioni come architettura avanzata, sofisticate tecniche di formazione e set di dati di alta qualità consentono ai modelli più piccoli di competere con sistemi più grandi in termini di prestazioni.

- Ottimizzato per l’edge computing, Queue 3.5 riduce la latenza, migliora la reattività e supporta l’elaborazione IA localizzata in tempo reale per attività come il rilevamento di anomalie e il riconoscimento delle immagini.

- L’attenzione di Alibaba su modelli di intelligenza artificiale compatti e versatili la rende leader nelle soluzioni di intelligenza artificiale incentrate sulla privacy e compatibili con l’hardware, plasmando il futuro dell’implementazione dell’intelligenza artificiale.

La serie Quen 3.5 offre una vasta gamma di dimensioni del modello, soddisfacendo diverse esigenze computazionali senza compromettere le prestazioni. A differenza di molti laboratori di intelligenza artificiale che danno priorità allo sviluppo di modelli su larga scala, Alibaba adotta una strategia inclusiva, garantendo che i modelli più piccoli rimangano potenti e versatili.

- Modello da 9 miliardi di parametri Fornisce prestazioni più elevate rispetto alle controparti più grandi, eccellendo in benchmark come MMLU per attività complesse.

- Modello da 800 milioni di parametri È ottimizzato per applicazioni leggere, rendendolo ideale per ambienti con risorse limitate come i dispositivi IoT.

Questa flessibilità consente agli sviluppatori di scegliere modelli che si allineano a casi d’uso specifici, dall’elaborazione ad alte prestazioni alle attività di intelligenza artificiale di base su dispositivi a basso consumo. Affrontando un ampio spettro di esigenze, QUOTE 3.5 garantisce che la tecnologia AI sia accessibile a un vasto pubblico, comprese le industrie e i consumatori con risorse computazionali limitate.

innovazione che guida l’efficienza

L’efficienza di QUEN 3.5 deriva da diversi progressi chiave che consentono ai modelli più piccoli di ottenere risultati tradizionalmente associati a sistemi più grandi:

- Architettura avanzata: I modelli presentano design ottimizzati che massimizzano l’efficienza computazionale e la densità di intelligenza, garantendo prestazioni elevate in forme compatte.

- Tecniche di allenamento sofisticate: I metodi avanzati consentono ai modelli più piccoli di eseguire compiti complessi, colmando il divario tra dimensioni e capacità.

- Set di dati di alta qualità: L’uso di set di dati curati e diversificati garantisce che i modelli siano accurati, versatili e in grado di gestire un’ampia gamma di applicazioni.

Ad esempio, il modello da 9 miliardi di parametri eccelle nella comprensione del linguaggio naturale e nelle attività multimodali, rivaleggiando con predecessori più grandi e richiedendo allo stesso tempo meno risorse computazionali. Queste innovazioni non solo riducono le richieste hardware, ma rendono anche l’intelligenza artificiale più accessibile ai dispositivi con capacità limitate, come smartphone e sistemi IoT.

Scopri di più su Quen negli altri articoli e guide che abbiamo scritto di seguito.

Ottimizzato per dispositivi Edge

Una caratteristica distintiva di Queue 3.5 è la sua ottimizzazione per i dispositivi edge, consentendo il calcolo locale su hardware di livello consumer. Questo approccio offre diversi vantaggi distinti:

- Privacy migliorata: Elaborando i dati localmente, i modelli riducono la necessità di trasmettere informazioni sensibili a server esterni, riducendo così i rischi per la privacy.

- Funzionalità offline: La capacità di lavorare senza accesso a Internet rende questi modelli ideali per ambienti remoti o sicuri.

Ad esempio, il modello da 9 miliardi di parametri può alimentare funzionalità avanzate di intelligenza artificiale sugli smartphone, mentre il modello da 800 milioni di parametri è adatto per attività di intelligenza artificiale di base sui dispositivi IoT. Questa adattabilità garantisce che Kwen 3.5 possa soddisfare le esigenze di un’ampia gamma di utenti, dai singoli consumatori alle applicazioni industriali. Consentendo l’elaborazione dell’intelligenza artificiale localizzata in tempo reale, questi modelli aumentano la reattività e riducono la latenza, rendendoli particolarmente preziosi per le attività sensibili al fattore tempo.

Ampliare il potenziale dell’IoT e dell’edge computing

La serie Quen 3.5 evidenzia il ruolo crescente dell’intelligenza artificiale nell’IoT e nell’edge computing, dove modelli piccoli ed efficienti sono essenziali per il calcolo sul dispositivo. La variante da 800 milioni di parametri, in particolare, è adatta all’ecosistema IoT, consentendo funzioni come:

- Analisi dei dati in tempo reale per informazioni immediate

- Rilevamento di anomalie per identificare modelli o problemi irregolari

- Riconoscimento delle immagini per applicazioni quali sicurezza e automazione

Elaborando i dati direttamente sui dispositivi, questi modelli riducono la latenza e migliorano la reattività, rendendoli ideali per le applicazioni che richiedono un’azione immediata. Inoltre, l’inclusione di funzionalità multimodali, come la gestione sia di testo che di immagini, amplia la portata dei possibili casi d’uso. Ad esempio, un sistema di casa intelligente basato su Kwen 3.5 può integrare perfettamente i comandi vocali con i feed della fotocamera, creando un’esperienza utente più intuitiva ed efficiente.

Plasmare il futuro dell’implementazione dell’IA

L’attenzione di Alibaba su modelli piccoli ed efficienti consente di soddisfare la crescente domanda di intelligenza artificiale nell’edge computing e nelle applicazioni incentrate sulla privacy. Questa strategia contrasta con l’approccio di molti laboratori di intelligenza artificiale, che preferiscono modelli su larga scala progettati per l’implementazione centralizzata del cloud. La serie Quen 3.5 dimostra che i modelli più piccoli possono fornire prestazioni comparabili offrendo allo stesso tempo vantaggi unici:

- Migliore privacy: Il calcolo locale riduce la necessità di trasmissione dei dati, aumentando la sicurezza.

- bassa latenza: L’elaborazione in tempo reale garantisce una risposta rapida alle applicazioni critiche.

- Ampia compatibilità hardware: I modelli più piccoli possono funzionare su un’ampia gamma di dispositivi, dagli smartphone ai sistemi IoT.

Con l’evoluzione del panorama dell’intelligenza artificiale, questi modelli potrebbero ridefinire gli standard del settore, bilanciando efficienza e capacità. Dando priorità all’accessibilità e alla versatilità, Quen 3.5 stabilisce un nuovo punto di riferimento per l’implementazione dell’intelligenza artificiale, soprattutto in ambienti in cui le limitazioni hardware e i problemi di privacy sono fondamentali.

Basandosi su un’eredità di innovazione

La serie Qwen 3.5 si basa sulle fondamenta stabilite dai suoi predecessori, come Qwen 2 e Qwen 3. Questi modelli legacy hanno gettato le basi per l’impegno di Alibaba nella creazione di soluzioni AI versatili e accessibili. Nel corso del tempo, i progressi nella qualità dei dati di training, nelle tecniche di stabilizzazione e nella progettazione dell’architettura hanno consentito miglioramenti significativi delle prestazioni.

Ad esempio, la densità di intelligenza di Quen 3.5 è maggiore rispetto ai suoi predecessori, consentendo ai modelli più piccoli di ottenere risultati prima irraggiungibili. Questo progresso sottolinea l’impegno di Alibaba nel superare i limiti dei modelli di intelligenza artificiale compatti, garantendo che rimangano competitivi in un mercato sempre più esigente.

anticipando gli sviluppi futuri

La serie Quen 3.5 pone le basi per futuri progressi nell’intelligenza artificiale, poiché la concorrenza si intensifica con le prossime versioni di altri laboratori, come GPT-5.3 di OpenAI. L’attenzione di Alibaba sulla quantizzazione e sui modelli compatti le consente di affrontare un’ampia gamma di casi d’uso, dai dispositivi consumer ai sistemi IoT industriali. Possibili sviluppi futuri potrebbero includere:

- Modelli ancora più piccoli con funzionalità multimodali avanzate

- Maggiore efficienza per applicazioni IoT industriali su larga scala

- Ampia integrazione nell’elettronica di consumo e nei dispositivi intelligenti

Queste innovazioni possono espandere ulteriormente le possibilità dell’intelligenza artificiale, rendendola più accessibile, versatile e di impatto che mai. Continuando a dare priorità all’efficienza e all’adattabilità, Alibaba è pronta a svolgere un ruolo di primo piano nel plasmare il futuro dell’implementazione dell’intelligenza artificiale.

Credito mediatico: Caleb scrive codice

Archiviato in: AI, Top News

Divulgazione: Alcuni dei nostri articoli contengono link di affiliazione. Se acquisti qualcosa tramite uno di questi link, Geeky Gadgets potrebbe guadagnare una commissione di affiliazione. Scopri la nostra politica di divulgazione.