Durante il fine settimana, Andrej Karpathy, ex leader dell’intelligenza artificiale di Tesla, cofondatore ed ex membro di OpenAI, che ha coniato il termine "codifica delle vibrazioni"— Pubblicato su X A proposito del nuovo progetto open source, ricerca automatica.

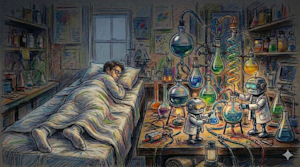

Non si trattava di un modello finito o di un enorme prodotto aziendale: come ammise, si trattava di una semplice sceneggiatura di 630 righe. Disponibile su Github È coperto da una licenza MIT permissiva e di facile utilizzo per le aziende. Ma l’obiettivo era enorme: automatizzare il metodo scientifico con agenti di intelligenza artificiale mentre noi umani dormiamo.

"L’obiettivo è progettare i tuoi agenti in modo che forniscano il progresso di ricerca più rapido a tempo indeterminato e senza il tuo coinvolgimento." affermato in X.

Il sistema funziona come un ciclo di ottimizzazione autonomo. A un agente AI viene fornito uno script di formazione e un budget di calcolo fisso (di solito 5 minuti sulla GPU).

Legge il proprio codice sorgente, crea un’ipotesi di miglioramento (come la modifica del tasso di apprendimento o della profondità dell’architettura), modifica il codice, esegue l’esperimento e valuta i risultati.

Se la perdita di verifica viene misurata in bit per byte (val_bpb)—guarisce, preserva il cambiamento; In caso contrario, torna indietro e riprova. Dentro In uno studio notturno, il rappresentante di Karpathy ha completato 126 esperimentiha ridotto la perdita da 0,9979 a 0,9697.

Oggi, Karpathy ha riferito che stava per apportare una modifica dopo aver lasciato l’agente. "profondità=12" modello con successo per due giorni. implementato circa 700 modifiche autonome.

Il rappresentante ha riscontrato circa 20 ulteriori miglioramenti che si trasferiscono perfettamente ai modelli più grandi. Sommando questi cambiamenti, "Ora GPT-2" la misurazione in classifica è aumentata da 2,02 ore a 1,80 ore; Un aumento della produttività dell’11% su un progetto che Karpathy ritiene sia già ben messo a punto.

"Vedere l’agente eseguire l’intero flusso di lavoro end-to-end da solo… è pazzesco," Karpathy ha notato che l’agente ha riscontrato carenze nel ridimensionamento e nell’organizzazione dell’attenzione che aveva trascurato manualmente per più di due decenni.

Questo è molto più di un semplice trucco per la produttività; Si tratta di un cambiamento fondamentale nel modo in cui viene sviluppata l’intelligenza. Automatizzando "metodo scientifico" Nel codice, Karpathy ha trasformato l’apprendimento automatico in un processo evolutivo che corre alla velocità del silicio piuttosto che alla velocità del pensiero umano.

Inoltre, lo ha dimostrato alla più ampia comunità di intelligenza artificiale e machine learning

La ricerca automatizzata si sta diffondendo ovunque

La risposta è stata rapida e virale; Il post di Karpathy è stato visto più di 8,6 milioni di volte negli ultimi due giorni mentre costruttori e ricercatori cercano di ridimensionare i costruttori. "Ciclo dei Carpazi".

Varun Mathur, CEO della piattaforma di aggregazione di veicoli AI Hyperspace AI, ha dichiarato: ha preso il ciclo ad agente singolo e lo ha distribuito su una rete peer-to-peer. Ogni nodo che esegue l’agente iperspaziale è diventato un ricercatore autonomo.

Nella notte tra l’8 e il 9 marzo, 35 agenti autonomi della rete Iperspazio hanno condotto 333 esperimenti, completamente senza supervisione. I risultati sono stati un masterclass sulla strategia emergente:

-

Diversità hardware come caratteristica: Mathur ha dichiarato che vengono utilizzate GPU H100 "forza bruta" Per trovare tassi di apprendimento aggressivi, gli agenti basati solo sulla CPU sui laptop sono stati costretti a diventare intelligenti. Questi "oppresso" I broker si concentravano sulle strategie di inizializzazione (come Kaming e Xavier init) e sulle opzioni di normalizzazione perché non potevano fidarsi dell’output grezzo.

-

Scoperta di pettegolezzi: Gli agenti hanno condiviso i loro guadagni in tempo reale utilizzando il protocollo GossipSub. Quando un rappresentante ha scoperto che il lancio di Kaiming riduceva i danni del 21%, l’idea si è diffusa in rete come un virus digitale. Nel giro di poche ore, altri 23 agenti incorporarono la scoperta nelle proprie ipotesi.

-

Compressione della storia: In sole 17 ore, questi agenti hanno riscoperto in modo indipendente pietre miliari dell’apprendimento automatico come RMSNorm e incorporamenti connessi che hanno richiesto ai ricercatori umani in laboratori come Google Brain e OpenAI quasi otto anni per formalizzare.

Esegui 36.500 esperimenti di marketing ogni anno invece di 30

Mentre i puristi del machine learning si concentravano sulle curve di perdita, il mondo degli affari ha assistito a un diverso tipo di rivoluzione. Eric Siu, fondatore dell’agenzia pubblicitaria Single Grainricerca automatizzata applicata "Ciclo dell’esperimento" marketing.

"La maggior parte dei team di marketing esegue circa 30 esperimenti all’anno." Scrisse a Siu X. "La prossima generazione ne avrà più di 36.500. Facilmente." Ha continuato:

"Condurranno esperimenti mentre dormono. Gli attuali team di marketing eseguono 20-30 esperimenti all’anno. Se sono “buoni” forse 52. Nuova pagina di destinazione. Nuova creatività. Forse un test sull’oggetto. questo si pensava "marketing basato sui dati."

Ma i sistemi di marketing di prossima generazione eseguiranno più di 36.500 esperimenti all’anno."

La struttura di Siu sostituisce lo scenario di formazione con una risorsa di marketing: una pagina di destinazione, una creatività o un’e-mail fredda. L’agente modifica una variabile (riga dell’oggetto o CTA), la distribuisce, "tasso di risposta positiva," e mantiene o lancia.

Siu sostiene che questo crea a "mappa speciale" un fossato in cui ciò che risuona con un particolare pubblico è costruito da una storia di sperimentazione, non da codice. "Le aziende vincenti non avranno professionisti del marketing migliori," ha scritto, "avranno cicli di prova più rapidi".

Discussione comunitaria e “corruzione” del set di convalida

Nonostante l’eccitazione, Discussioni su GitHub Ha rivelato una comunità alle prese con le conseguenze di un progresso così rapido e automatico.

La trappola dell’ottimizzazione eccessiva: Ricercatore alessiste Ha suscitato seria preoccupazione: "Non sei preoccupato che il lancio di così tanti esperimenti finirà per “corrompere” il set di validazione?". Il timore è che con un numero sufficiente di agenti, i parametri verranno ottimizzati per peculiarità specifiche dei dati di test piuttosto che per l’intelligenza generale.

Significato dei risultati: Utente samionb Ci si è chiesti se il calo da 0,9979 a 0,9697 sia stato effettivamente evidente. La risposta di Karpathy è stata tipicamente diretta: "Tutto ciò che stiamo facendo è ottimizzare le prestazioni per calcolo… questi sono vantaggi reali e significativi"

Elemento umano: utente in X stregaResponsabile della crescita presso la piattaforma crittografica SemifinanzaHa documentato le sue corse notturne sul Mac Mini M4, notando che 26 esperimenti su 35 sono falliti o si sono bloccati, mentre i sette esperimenti riusciti hanno rivelato che: "Il modello è diventato più semplice e migliore".

L’idea che meno è spesso di più è stata raggiunta senza un singolo intervento umano.

Il futuro: la curiosità come collo di bottiglia

L’introduzione della ricerca automatizzata punta a un futuro di ricerca in tutti i campi in cui il ruolo dell’essere umano sta cambiando grazie a semplici meccanismi di istruzione dell’intelligenza artificiale. "sperimentatore" con "progettista sperimentale."

Man mano che strumenti come DarkMatter, Optimization Arena e NanoClaw emergono per supportare questo gruppo, il collo di bottiglia nel progresso dell’IA non è più "computer di carne" La capacità di codificare (la descrizione del cervello umano di Karpathy): questa è la nostra capacità di definire i confini della ricerca.

Andrej Karpathy ha cambiato ancora una volta la scena. Non ci limitiamo più a codificare modelli; Seminiamo i semi di ecosistemi che imparano mentre dormiamo.