Gli ingegneri che sviluppano agenti browser oggi devono scegliere tra API chiuse che non possono controllare e framework aperti senza alcun modello addestrato alla base. Ai2 ora offre una terza opzione.

Dietro c’è un’organizzazione no-profit con sede a Seattle OLMo open source modelli linguistici e Bocca La famiglia Vision-Language lancia oggi MolmoWeb, un agente web visivo open-heavy disponibile in 4 miliardi e 8 miliardi di dimensioni di parametri. Finora, nessun agente web visivo molto aperto ha fornito i dati di addestramento e la pipeline necessaria per ispezionarli o replicarli. MolmoWeb fa questo. Il set di dati complementare, MolmoWebMix, contiene 30.000 traiettorie di attività umane, 590.000 rappresentazioni di sottoattività individuali e 2,2 milioni di coppie di domande-risposte di screenshot in oltre 1.100 siti Web; Ai2 li descrive come la più grande raccolta pubblica di attività web umane mai raccolta.

"Riesci a passare dalla comprensione, descrizione e didascalia passiva delle immagini al farle effettivamente agire in alcuni ambienti?" Tanmay Gupta, ricercatore senior presso Ai2, ha dichiarato: VentureBeat. "MolmoWeb è proprio questo."

Come funziona: Vede ciò che vedi tu

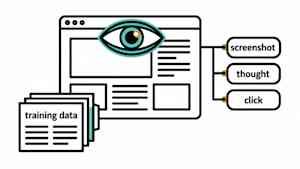

MolmoWeb funziona interamente partendo dagli screenshot del browser. Non analizza l’HTML né si basa sulle rappresentazioni dell’albero di accessibilità di una pagina. Ad ogni passaggio, recupera un’istruzione dell’attività, lo screenshot corrente, un registro di testo delle azioni precedenti e il titolo della pagina con l’URL corrente. Genera un pensiero in linguaggio naturale che descrive la sua logica e quindi esegue l’azione successiva del browser (fare clic sulle coordinate dello schermo, digitare testo, scorrere, andare a un URL o cambiare scheda).

Il modello è indipendente dal browser. Richiede solo uno screenshot; Ciò significa che funziona con Chrome nativo, Safari o un servizio browser ospitato. La demo ospitata utilizza Browserbase, un’avvio dell’infrastruttura del browser cloud.

Il set di dati che lo fa funzionare

Il peso dei modelli è solo una frazione di ciò che Ai2 offre sul mercato. Il set di dati di formazione allegato, MolmoWebMix, è il principale elemento di differenziazione da tutti gli altri broker con grandi lacune oggi disponibili.

"I dati si presentano sostanzialmente come una serie di screenshot e azioni abbinati a istruzioni su quale sia l’intento dietro questa serie di screenshot." disse Gupta.

MolmoWebMix combina tre componenti.

Dimostrazioni umane. Gli annotatori umani hanno completato le attività di navigazione utilizzando un’estensione Chrome personalizzata che ha registrato azioni e screenshot su oltre 1.100 siti Web. Il risultato sono 30.000 traiettorie di missione che coprono più di 590.000 rappresentazioni di sottoattività individuali.

Orbitali sintetici. Ai2 ha generato traiettorie aggiuntive utilizzando agenti dell’albero di raggiungibilità basati su testo (esecuzioni con agente singolo filtrate per il successo delle attività, pipeline multi-agente che dividono le attività in obiettivi secondari e percorsi di navigazione deterministici attraverso centinaia di siti Web) per andare oltre ciò che la sola annotazione umana potrebbe fornire. Fondamentalmente, non sono stati utilizzati agenti visivi proprietari. I dati sintetici provenivano da sistemi di solo testo, non dall’operatore OpenAI o dall’API informatica di Anthropic.

Dati sulla percezione della GUI. Un terzo componente addestra il modello a leggere e ragionare sul contenuto della pagina direttamente dalle immagini. Contiene più di 2,2 milioni di coppie di domande-risposte di screenshot provenienti da quasi 400 siti Web, che coprono attività di base degli elementi e di ragionamento basate su screenshot.

"Se riesci a eseguire un’attività e registrarne una traiettoria, dovresti essere in grado di addestrare l’agente web a svolgere esattamente la stessa attività su quella traiettoria." disse Gupta.

Come si colloca MolmoWeb rispetto alla concorrenza?

Secondo Gupta, ci sono due categorie di tecnologie nel mercato dei browser broker.

I primi sono sistemi capaci ma chiusi, solo API, senza visibilità sulla formazione o sull’architettura. OpenAI Operator, l’API di calcolo di Anthropic e il calcolo Gemini di Google rientrano in questo gruppo. Il secondo riguarda i modelli ad alto deficit, che sono una categoria molto più piccola. L’alternativa aperta più ampiamente adottata, utilizzando un browser, è un framework piuttosto che un modello addestrato. Richiede agli sviluppatori di fornire il proprio LLM e di creare sopra il livello intermedio.

MolmoWeb rientra nella seconda categoria in quanto modello di visualizzazione a peso aperto completamente addestrato. Ai2 riporta di essere leader di questo gruppo in quattro benchmark di siti Web live: WebVoyager, Online-Mind2Web, DeepShop e WebTailBench. Secondo Ai2, supera gli agenti legacy basati su API basati su GPT-4o con il suo albero di accessibilità e l’input dello screenshot.

Ai2 documenta diverse limitazioni esistenti nella versione. Il modello occasionalmente commette errori durante la lettura del testo dagli screenshot, le interazioni drag-and-drop rimangono inaffidabili e le prestazioni risentono di istruzioni ambigue o eccessivamente limitate. Inoltre, il modello non è stato addestrato su attività che richiedevano accessi o transazioni finanziarie.

I team aziendali che valutano gli agenti browser non scelgono solo un modello. Decidono se possono controllare ciò che eseguono, ottimizzare i flussi di lavoro interni ed evitare la dipendenza dalle API per chiamata.