Zuckerberg ha anche mostrato come l’interfaccia neurale potrebbe essere utilizzata per comporre messaggi (WhatsApp, Messenger, Instagram o qualsiasi applicazioni di messaggi telefonici connessi) seguendo la mummia “calligrafia” su una superficie piana. Sebbene questa funzione non sia disponibile al momento del lancio, Zuckerberg ha affermato che in questa modalità di input silenziosa ha avuto “circa 30 parole al minuto”.

La parte più impressionante del demor sul palco di Zuckerberg che può essere trovata al lancio probabilmente aveva una funzione “didascalia dal vivo” che ha digitato automaticamente le parole che il tuo partner dice in tempo reale. Le funzionalità filtrano la parola sfondo per concentrarsi solo per dare la didascalia proprio mentre guardi la persona che stai guardando.

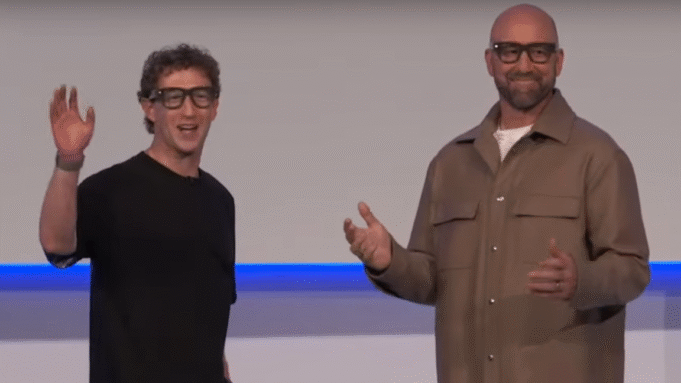

In che modo una demo di meta video funziona sul display di re-banding in diretta (sebbene il campo di vista sia probabilmente molto più limitato negli occhiali reali).

Credito: meta

Oltre a questo tipo di tipo “G Whiz”, il display Meta Re-Ban è fondamentalmente un piccolo sottoinsieme sul display mobile delle tue applicazioni per smartphone. In grado di ottenere la direzione girevole o di guardare i passaggi della ricetta degli occhiali senza prestare attenzione a un telefono, sembra davvero una nuova modalità di interazione utile. L’uso degli occhiali come mirino per una foto o un video (utilizzando una fotocamera zoom 3x da 12 megapixel incorporata) sembra un miglioramento rispetto al precedente Smartglass senza display.

Tuttavia, accedere a applicazioni di base come meteo, promemoria, calendari ed e -mail nei tuoi piccoli occhiali ci fa male meno che guardare il flash sul telefono. E ospitare videochiamate per occhiali per requisiti costringono il tuo partner a vedere cosa stai vedendo attraverso una fotocamera esterna della bocca piuttosto che visualizzare il viso originale.

Meta ha anche mostrato alcuni video PI-in-the-Sky su come l’integrazione “Agent AI” fosse automaticamente consulenza e indossare occhiali saranno in grado di notare che il follow-up funziona in base a ciò che vedi e ascolti. Improvvisamente, il dispositivo si chiama Zuckerberg “La prossima sezione della futura storia entusiasmante del computer”, che dovrebbe essere focalizzata lontano dal fallito Metvers basato su VR, che è l’ultimo “futuro del calcolo” dell’azienda.