Per la maggior parte di noi, l’idea che una persona cara possa comunicare con noi utilizzando l’intelligenza artificiale è snervante. Dopotutto, l’autenticità è una pietra miliare dell’interazione umana. La ricerca che faccio sul coinvolgimento della comunitàGementoParlo spesso di autenticità e intelligenza emotiva: la capacità di leggere e navigare nelle emozioni di una persona. Entrambe le proprietà sono essenziali nella forgiatura Connessioni e collaborazioni sostenibili e affidabili con gli esseri umani, e queste sono due delle poche cose rimaste che distinguono la cognizione umana dall’intelligenza artificiale.

Lo “schifo” che proviamo quando sospettiamo che qualcuno stia usando l’intelligenza artificiale in una conversazione privata con noi ha un nome reale: Sindrome di Capgras. Prende il nome dallo psichiatra francese Joseph Capgras, questa rara condizione, descritta per la prima volta negli anni ’20, parla di una paura profondamente interiorizzata che qualcuno (o qualcosa) che conosciamo sia un “impostore”: in questo caso, il tuo assistente AI residente.

Negli ultimi anni, i baroni dell’intelligenza artificiale hanno scaricato carichi di ricerca e sviluppo Affrontare il divario di autenticità dell’intelligenza artificiale. La loro speranza è quella di eliminare la misteriosa valle misteriosa dell’intelligenza artificiale, un effetto che da tempo ha fatto sembrare la tecnologia più una novità fantascientifica che un dispositivo che può svolgere una funzione pratica nella vita quotidiana delle persone. A tal fine, la Big AI è riuscita, come minimo, a sradicare la percezione umana di autenticità istruzione, l’industria E Assistenza clienti. Ora dobbiamo fare i conti con l’idea che l’intelligenza artificiale stia iniziando a rendere le nostre relazioni e interazioni personali con gli altri meno autentiche e potenzialmente meno significative.

Le nostre preoccupazioni sono già elevate su questa vasta questione. In un sondaggio YouGov di marzoL’80% degli americani afferma di essere molto o abbastanza preoccupato per il fatto che l’intelligenza artificiale possa portare alla manipolazione del comportamento umano. Ciò avviene in un contesto di erosione generazionale della fiducia reciproca: solo un terzo degli americani nel 2024 Rapporto La sensazione che ci si possa fidare della maggior parte delle persone è in calo rispetto a circa la metà del 1984, quando i numeri dei sondaggi raggiunsero il picco. (Come un’istantanea, sull’immersione nella fede Orwelliano quanto può essere.)

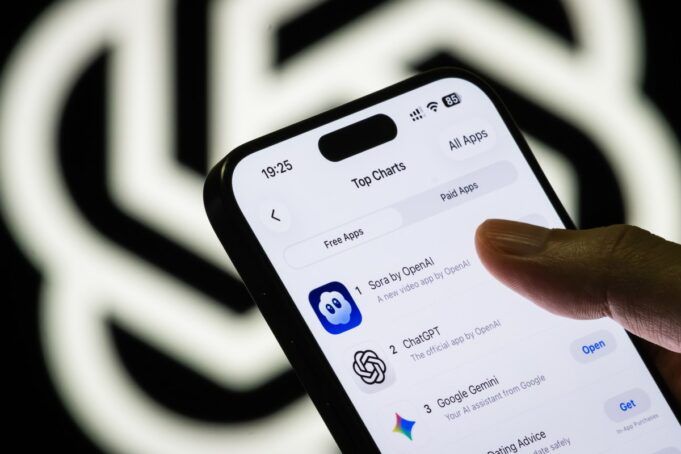

La fiducia interpersonale è destinata a diminuire man mano che l’intelligenza artificiale diventa rapidamente uno strumento su cui ci appoggiamo sempre di più come comunicatore surrogato, non solo Le nostre e-mail e report professionaliMa tra di noi Profilo di incontri in linea, Lettera di scuse ai propri cari E Buon compleanno. Foto e video sempre più sofisticati generati dall’intelligenza artificiale significano che possiamo diffidare dei media personali che amici e familiari condividono con noi. Immagina, ad esempio, che si creda che il video Instagram di un cugino della loro vacanza a Parigi sia stato falsificato attraverso un generatore video AI senza interruzioni. Sora.

Sebbene alle persone possa piacere utilizzare l’intelligenza artificiale come strumento di scrittura, non sono così entusiasti di essere il destinatario. In studi condotti negli Stati Uniti e nel Regno UnitoI ricercatori hanno scoperto che la maggior parte delle persone considera inappropriato l’uso non dichiarato dell’IA nei messaggi interpersonali e quando le persone rivelano di aver utilizzato l’IA, Sono meno fidati.

Il nostro miglior approccio per affrontare l’intrusione dell’intelligenza artificiale nei nostri spazi interpersonali non è costruire barriere per fermarla. Sii più consapevole di quando e perché viene utilizzato. oltre il sapere segni rivelatori Utilizzando l’intelligenza artificiale, abbiamo bisogno autenticazione Strumenti che dicono alle persone cosa è generato dall’intelligenza artificiale e cosa no. Ciò può variare dalla filigrana dei contenuti AI a strumenti più complessi come la crittografia Monitoraggio della fonteCiò comporta la creazione di metadati o “tracce di dati” che consentono agli utenti finali di sapere come, quando e dove è stato creato il contenuto. Ma questi approcci sono tutt’altro che infallibili, anche se richiedono sforzo Rimuovi filigrane AI E Distruggi i metadati dell’IA Probabilmente rivaleggiando con lo sforzo stesso di crearli.

Politici dell’IA Da tempo sostengo l’autenticazione, ma i legislatori statunitensi devono ancora sostenerla in modo significativo. Anche i leader dell’intelligenza artificiale come Sam Altman, CEO di OpenAI (creatore di ChatGPT) sono stati sottoposti a restrizioni. avvocatoE questo è dovuto principalmente al fatto che riconoscono che una delle principali attrattive dell’intelligenza artificiale per molti è che sembra “reale”. L’autenticazione rimuove quell’illusione. Inoltre, l’autenticazione, riducendo il modo in cui presentiamo i contenuti, solleva alcune ammissioni La questione spinosa della libertà di parola. Tuttavia, il bisogno di trasparenza della società dovrebbe essere maggiore. E infine, un profondo impegno politico a favore dell’autenticazione può aiutare a contrastare il pubblico Diffusa sfiducia nei confronti delle aziende di intelligenza artificiale E facilitare un maggiore comfort riguardo all’integrazione dell’intelligenza artificiale nelle nostre vite.

Nel 2024 è iniziata l’amministrazione Biden Le agenzie federali devono rivelare pubblicamente il loro utilizzo dell’intelligenza artificiale. Attualmente il presidente Donald Trump Piano d’azione sull’IA, In accordo con il generale della sua amministrazione Opposizione alle iniziative di trasparenzaNon abbracciare questo approccio. Il Congresso richiederà che le piattaforme di intelligenza artificiale, come quelle offerte da OpenAI, Google, Microsoft e Apple, includano il monitoraggio della provenienza e forniscano agli utenti un modo semplice per determinare se un particolare pezzo, come un video clip, una canzone o anche un messaggio di testo, è stato creato dall’intelligenza artificiale. Tali recinzioni sono imperfette, ma possono indurre chiunque intenda utilizzare l’intelligenza artificiale in modi fraudolenti o distruttivi a pensarci due volte. E questi guardrail possono ancora aiutarci a mantenere almeno una delle nostre vite completamente libere dall’intelligenza artificiale, ammesso che sia ciò che realmente vogliamo.

Jerel Ezell è sociologo e professore assistente presso il Medical Center dell’Università di Chicago. Studia gli aspetti culturali della salute e della tecnologia.

Le opinioni espresse in questo articolo appartengono all’autore.