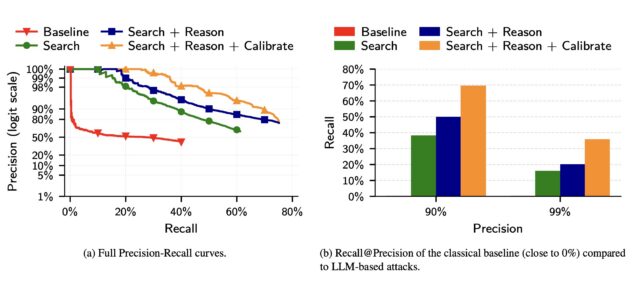

Richiamo a diverse soglie di precisione.

In un terzo esperimento, i ricercatori hanno preso 5.000 utenti dal set di dati Netflix e hanno aggiunto altre 5.000 identità di “distrazione” di persone non presenti nei risultati. Hanno quindi aggiunto 5.000 distruttori di query a un elenco di 10.000 profili candidati per mostrare che gli utenti compaiono in un solo set di query, senza corrispondenze reali nel pool di candidati.

Rispetto a una linea di base classica che simula l’attacco del Premio Netflix alla deanimazione LLM, quest’ultima supera la prima.

I ricercatori hanno scritto:

(a) La precisione dell’attacco classico diminuisce molto rapidamente, il che spiega il suo basso richiamo. Al contrario, la precisione degli attacchi basati su LLM diminuisce in modo più graduale man mano che l’aggressore fa più ipotesi. (b) Gli attacchi classici falliscono quasi completamente anche con una precisione moderatamente bassa. Al contrario, anche il più semplice attacco LLM (ricerca) raggiunge un richiamo non banale con bassa precisione ed estendendolo con passaggi di fattore e calibrazione raddoppia il richiamo con una precisione del 99%.

I risultati mostrano che gli LLM, pur essendo ancora soggetti a falsi positivi e ad altri punti deboli, stanno rapidamente superando i metodi più tradizionali e ad alta intensità di risorse per identificare gli utenti online.

I ricercatori hanno poi proposto soluzioni di mitigazione, inclusa la richiesta alle piattaforme di imporre limiti di velocità sull’accesso API ai dati degli utenti, rilevare lo scraping automatico e limitare le esportazioni di dati in blocco. I fornitori di LLM possono anche monitorare i propri modelli per individuare eventuali abusi di attacchi di deanonimizzazione e creare recinzioni che rifiutano le richieste di deanonimizzazione ai modelli.

Naturalmente, un’altra opzione è che le persone limitino drasticamente l’uso dei social media o, per lo meno, eliminino regolarmente i post dopo un certo periodo di tempo.

Se il successo di LLM nell’anonimizzazione delle persone migliorasse, avvertono i ricercatori, i governi potrebbero utilizzare tecniche per smascherare i critici online, le aziende potrebbero raccogliere profili di clienti per “pubblicità iper-mirata” e gli aggressori potrebbero creare profili target per lanciare truffe di ingegneria sociale altamente personalizzate.

“I recenti progressi nelle capacità LLM hanno reso chiaro che c’è un urgente bisogno di ripensare vari aspetti della sicurezza informatica alla luce delle capacità informatiche offensive guidate dal LLM, hanno avvertito i ricercatori. “Il nostro lavoro mostra che lo stesso è probabilmente vero per la privacy.”