Lo strumento video di OpenAI Sora 2 ha vietato l’uso di sembianze umane reali e personaggi protetti da copyright nei video generati dall’intelligenza artificiale dopo la reazione negativa di celebrità, creatori e detentori di diritti.

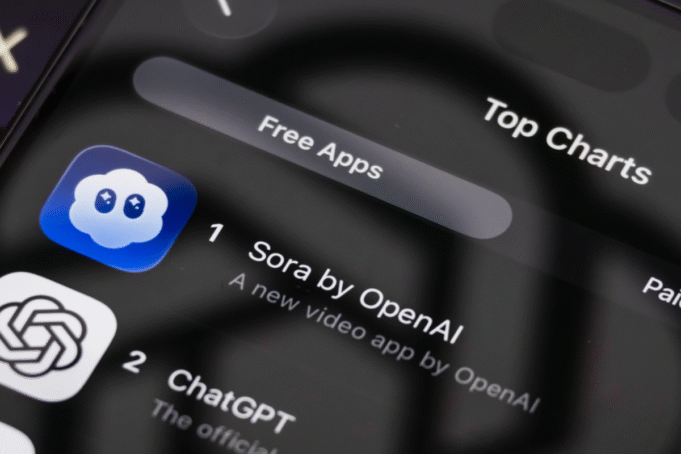

Sora, che OpenAI ha rilasciato pubblicamente nel dicembre 2024, può generare video altamente realistici in pochi secondi dopo aver inserito un messaggio di testo o un’immagine.

I video creati con la piattaforma hanno guadagnato l’attenzione virale per il loro bizzarro realismo, con clip di tutto, dallo skateboard di Topolino a Jake Paul vestito da Campanellino.

Ma quando gli utenti di Sora 2 hanno iniziato a ricreare celebrità senza consenso, OpenAI è stata costretta ad agire.

Secondo la politica aggiornata dell’azienda, qualsiasi persona o personaggio deve aderire prima di utilizzare la propria immagine.

Lunedì, l’attore Bryan Cranston ha rilasciato una dichiarazione attraverso la Screen Actors Guild-American Federation of Television and Radio Artists (SAG-AFTRA), elogiando pubblicamente OpenAI per aver inasprito le regole dopo le lamentele di attori i cui volti e voci sono apparsi nei clip AI senza permesso.

“Ero profondamente preoccupato non solo per me stesso, ma per tutti gli artisti il cui lavoro e la cui identità potevano essere abusati in questo modo”, ha detto Cranston. “Sono grato per i principi di OpenAI e per aver alzato la barriera.”

I video generati dall’intelligenza artificiale stanno diventando sempre più comuni su Internet, portando molte persone a chiedersi se ciò che vedono sia affidabile. Dai filmati di conigli che saltano sui trampolini ai bambini che nascono e camminano, alcuni video sono facili da guardare mentre altri possono ingannare gli spettatori.

Vasant Dhar, professore alla Stern School of Business della New York University e autore del libro di prossima uscita Pensare con le macchine: il nuovo mondo dell’intelligenza artificiale (Wiley, in uscita il 18 novembre), ha detto Newsweek Usare analogie con le persone nei contenuti dell’intelligenza artificiale non è “ovvio” da giustificare.

“Non mi è chiaro se si tratti di fair use”, ha detto Dhar Newsweek. “C’è molta ambiguità al riguardo: dipende da come verrà utilizzato. È difficile scegliere una politica che dica ‘questo potrebbe effettivamente funzionare a beneficio dell’umanità, quindi teniamolo aperto’, anche se sappiamo che ci sono tutti i tipi di potenziali danni ad esso associati. “

La scappatoia delle celebrità morte

Il nuovo guardrail però non copre tutti. Gli utenti continuano a creare contenuti con personaggi morti come Robin Williams, Michael Jackson ed Elvis Presley.

Il 17 ottobre la famiglia di Martin Luther King Jr. ha esercitato con successo pressioni su Sora 2 per bloccarne la somiglianza, ma altre proprietà non sono state altrettanto fortunate. La figlia di Williams, Zelda Williams, ha recentemente esortato gli utenti a “smettere di inviare video sull’intelligenza artificiale di papà”.

“Va tutto bene se hai un patrimonio e hai i mezzi e hai persone che hanno a cuore la tua memoria e la tua eredità e possono dire: ‘Sto rinunciando a questo.’

Altre clip di celebrità morte includono filmati di Tupac Shakur con Marilyn Monroe e la defunta regina Elisabetta II che rubano da un supermercato.

La cosiddetta “scappatoia delle celebrità decedute” espone una zona grigia dal punto di vista legale: i diritti sulle sembianze postume variano ampiamente in tutto il mondo, offrendo alle famiglie poche possibilità di ricorso.

Venerdì, OpenAI ha dichiarato in una dichiarazione: “Sebbene esista un forte interesse per la libertà di parola nel rappresentare personaggi storici, OpenAI ritiene che i personaggi pubblici e le loro famiglie dovrebbero in definitiva avere il controllo su come vengono utilizzate le loro sembianze. Rappresentanti autorizzati o proprietari immobiliari possono richiedere che le loro sembianze non siano utilizzate nei cameo di Sora. “

Ad esempio, nella maggior parte dei casi la possibilità per le persone di rinunciare all’eredità non è sufficiente.

“In realtà è ancora più o meno per le persone che non hanno proprietà, che non hanno la capacità di difendersi, le cui proiezioni future potrebbero essere alterate dall’intelligenza artificiale, in modi non apprezzabili”, ha detto. “Possono prendere qualcuno che era un santo e trasformarlo in un diavolo. È giusto? Penso che sia una china davvero scivolosa.”