L’ormai famoso team di sviluppo AI Qwen di Alibaba lo ha fatto di nuovo: poco più di un giorno fa, Serie di modelli medi Qwen3.5 Si compone di quattro nuovi principali modelli linguistici (LLM) che supportano il ride-hailing degli agenti; tre di questi sono disponibili per uso commerciale da parte di organizzazioni e sviluppatori indipendenti sotto la licenza standard open source Apache 2.0:

-

Qwen3.5-35B-A3B

-

Qwen3.5-122B-A10B

-

Qwen3.5-27B

Gli sviluppatori possono scaricarli ora da: viso abbracciato E Ambito del modello. Un quarto modello, Qwen3.5-Flash, è proprietario ed unico API Alibaba Cloud Model Studioma offre comunque un forte vantaggio in termini di costi rispetto ad altri modelli in Occidente (vedi tabella comparativa dei prezzi di seguito).

Ma il grande cambiamento con i modelli open source è che le principali startup statunitensi come OpenAI o Anthropic offrono prestazioni relativamente elevate nei benchmark di terze parti con i loro modelli personalizzati di dimensioni simili, superando di fatto il GPT-5-mini di OpenAI e il secondo modello di Anthropic, Claude Sonnet 4.5, rilasciato cinque mesi fa.

E la squadra Qwen dice ha progettato questi modelli per rimanere estremamente accurati. "quantizzato," un processo che riduce ulteriormente l’impronta riducendo i numeri in cui sono archiviate le impostazioni del modello a un numero di valori molto inferiore.

Ancora più importante, questa versione offre: "livello limite" trasferire le finestre di contesto sul computer desktop. L’ammiraglia Qwen3.5-35B-A3B può ora superare 1 milione di lunghezze di contesto token su GPU di livello consumer con 32 GB di VRAM. Sebbene non sia alla portata di tutti, si tratta di una potenza di elaborazione molto inferiore rispetto a molte altre opzioni con prestazioni comparabili.

Questo salto è reso possibile dalla precisione quasi senza perdite con un peso di 4 bit e dalla quantizzazione della cache KV, che consente agli sviluppatori di elaborare set di dati di grandi dimensioni senza infrastruttura a livello di server.

Tecnologia: Forza Delta

Al centro delle prestazioni di Qwen 3.5 c’è un’architettura ibrida avanzata. Mentre molti modelli si basano esclusivamente su blocchi Transformer standard, Qwen 3.5 combina Gated Delta Networks con un sistema sparso Mix of Experts (MoE). Le specifiche tecniche del Qwen3.5-35B-A3B rivelano un design altamente efficiente:

-

Efficienza dei parametri: Sebbene il modello contenga complessivamente 35 miliardi di parametri, si limita ad attivarli. 3 miliardi per qualsiasi moneta.

-

Diversità degli esperti: Il livello MoE sfrutta 256 esperti, inclusi 8 esperti diretti e 1 esperto condiviso, che aiuta a mantenere le prestazioni riducendo la latenza di inferenza.

-

Quantizzazione quasi senza perdite: La serie mantiene l’alta fedeltà anche se compressa a pesi a 4 bit e riduce significativamente l’ingombro della memoria per la distribuzione locale.

-

Versione del modello base: Per supportare la comunità di ricerca, Alibaba lo ha reso open source. Qwen3.5-35B-A3B-Base Modello e versioni adattate alle istruzioni.

Prodotto: Intelligenza che ‘pensa’ per prima

Qwen introduce la versione 3.5 nativa "Modalità di pensiero" come stato predefinito. Prima di fornire una risposta definitiva, il modello crea una catena di ragionamenti interni limitata a: <think> Tag: per lavorare su una logica complessa. La linea di prodotti è progettata specificamente per diversi ambienti hardware:

-

Qwen3.5-27B: Ottimizzato per un throughput elevato, supportando una lunghezza del contesto di oltre 800.000 token.

-

Qwen3.5-Flash: Versione ospitata in produzione con lunghezza del contesto token predefinita di 1 milione e strumenti ufficiali integrati.

-

Qwen3.5-122B-A10B: Progettato per GPU di classe server (80 GB VRAM), questo modello riduce il divario rispetto ai modelli edge più grandi del mondo, supportando al tempo stesso lunghezze di contesto di oltre 1 milione.

I risultati del benchmark confermano questo cambiamento architetturale. Il modello 35B-A3B supera notevolmente i predecessori molto più grandi come il Qwen3-235B, così come i già citati proprietari GPT-5 mini e Sonnet 4.5, in categorie che includono informazioni (MMMLU) e ragionamento visivo (MMMU-Pro).

Prezzi e integrazione API

Per coloro che non ne dispongono, Alibaba Cloud Model Studio fornisce un’API competitiva per Qwen3.5-Flash.

-

Entrata: $ 0,1 per 1 milione di token

-

Uscita: $ 0,4 per 1 milione di token

-

Creazione della cache: $ 0,125 per 1 milione di token

-

Lettura cache: $ 0,01 per 1 milione di token

L’API dispone anche di un modello di prezzo dettagliato per la ricerca dei veicoli; La ricerca sul Web costa $ 10 ogni 1000 chiamate e Code Interpreter è attualmente disponibile gratuitamente per un periodo limitato.

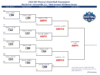

Ciò rende Qwen3.5-Flash uno dei più convenienti da eseguire tramite API tra tutti i principali LLM del mondo. Vedi una tabella che li confronta di seguito:

|

Modello |

Entrata |

Uscita |

Costo totale |

Fonte |

|

Qwen3Turbo |

$ 0,05 |

$ 0,20 |

$ 0,25 |

|

|

Qwen3.5-Flash |

$ 0,10 |

$ 0,40 |

$ 0,50 |

|

|

chat di ricerca approfondita (V3.2-Exp) |

$ 0,28 |

$ 0,42 |

$ 0,70 |

|

|

ragionatore di ricerca approfondito (V3.2-Exp) |

$ 0,28 |

$ 0,42 |

$ 0,70 |

|

|

Grok 4.1 Veloce (ragionamento) |

$ 0,20 |

$ 0,50 |

$ 0,70 |

|

|

Grok 4.1 Veloce (non ragionante) |

$ 0,20 |

$ 0,50 |

$ 0,70 |

|

|

MiniMax M2.5 |

$ 0,15 |

$ 1,20 |

$ 1,35 |

|

|

MiniMax M2.5-Lightning |

$ 0,30 |

$ 2,40 |

$ 2,70 |

|

|

Anteprima Flash di Gemini 3 |

$ 0,50 |

$ 3,00 |

$ 3,50 |

|

|

Kimi-k2.5 |

$ 0,60 |

$ 3,00 |

$ 3,60 |

|

|

GLM-5 |

$ 1,00 |

$ 3,20 |

$ 4,20 |

|

|

ERNI 5.0 |

$ 0,85 |

$ 3,40 |

$ 4,25 |

|

|

ClaudeHaiku4.5 |

$ 1,00 |

$ 5,00 |

$ 6,00 |

|

|

Qwen3-Max (23/01/2026) |

$ 1,20 |

$ 6,00 |

$ 7,20 |

|

|

Gemini 3 Pro (≤200.000) |

$ 2,00 |

$ 12,00 |

$ 14,00 |

|

|

GPT-5.2 |

$ 1,75 |

$ 14,00 |

$ 15,75 |

|

|

Claude Sonetto 4.5 |

$ 3,00 |

$ 15,00 |

$ 18,00 |

|

|

Gemini 3 Pro (>200K) |

$ 4,00 |

$ 18,00 |

$ 22,00 |

|

|

Chiudi Esegui 4.6 |

$ 5,00 |

$ 25,00 |

$ 30,00 |

|

|

GPT-5.2Pro |

$ 21,00 |

$ 168,00 |

$ 189,00 |

Cosa significa questo per i leader tecnici e i decisori aziendali?

Con il rilascio dei modelli intermedi Qwen3.5, l’iterazione rapida e la messa a punto, una volta riservate a laboratori ben finanziati, sono ora disponibili per lo sviluppo interno presso molte aziende non tecniche, separando di fatto l’intelligenza artificiale complessa dalle grandi spese in conto capitale.

Questa architettura trasforma il modo in cui i dati vengono elaborati e protetti in tutta l’azienda. La capacità di acquisire in modo nativo archivi di documenti di grandi dimensioni o video su scala oraria consente un’analisi aziendale approfondita senza i rischi per la privacy delle API di terze parti.

Impiegando questi esperti "Mix di esperti" Con i modelli all’interno di un firewall privato, le organizzazioni possono mantenere il controllo sovrano sui propri dati mentre utilizzano i dati locali. "pensiero" Mod e funzionalità ufficiali di ride-hailing per creare agenti più affidabili e autonomi.

I primi ad adottare l’Hugging Face erano particolarmente interessati al modello "restringere il divario" In scenari d’azione in cui prima potevano competere solo i modelli chiusi più grandi.

Questo spostamento verso l’efficienza dell’architettura su larga scala garantisce che l’integrazione dell’intelligenza artificiale rimanga attenta ai costi, sicura e sufficientemente agile da tenere il passo con le esigenze operative in evoluzione.