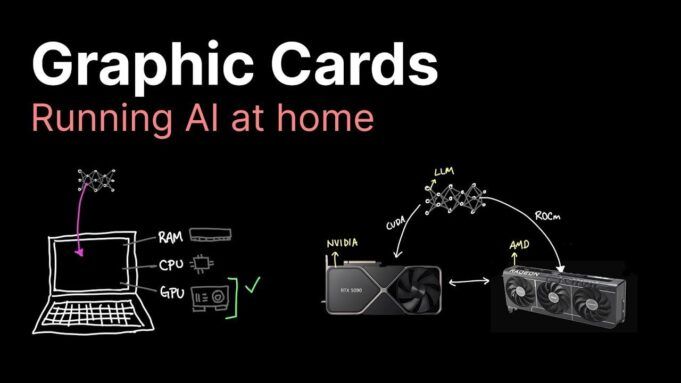

E se la chiave per sfruttare appieno il potenziale dell’intelligenza artificiale fosse proprio nel tuo computer? Mentre l’intelligenza artificiale sta trasformando i settori, dalla sanità alle arti creative, gli strumenti per sfruttarne la potenza stanno diventando più accessibili che mai. Tuttavia, un pezzo importante del puzzle viene spesso trascurato: scheda graficaSebbene le CPU siano state per lungo tempo la spina dorsale dell’informatica, vacillano di fronte alle richieste di elaborazione ampiamente parallela dei carichi di lavoro dell’intelligenza artificiale, Enter GPU, hardware specializzato in grado di elaborare miliardi di calcoli simultaneamente, rendendoli indispensabili per eseguire modelli di intelligenza artificiale in modo efficiente. Sia che tu stia addestrando una rete neurale o distribuendo un chatbot, la giusta GPU può fare la differenza tra ore e secondi,

Questa indagine di Caleb fornisce ulteriori informazioni Le GPU svolgono un ruolo essenziale nell’intelligenza artificialeGuidandoti attraverso il labirinto di opzioni per trovare la soluzione perfetta per le tue esigenze. Dai modelli economici ai potenti di fascia alta, evidenzieremo l’impatto di fattori come VRAM, potenza di calcolo e scalabilità sulle prestazioni. Scoprirai anche i compromessi tra hardware locale e soluzioni basate su cloud, nonché le tendenze future che modellano il panorama dell’intelligenza artificiale. Alla fine, non solo capirai perché le GPU sono importanti per l’intelligenza artificiale, ma ti sentirai anche in grado di prendere decisioni informate su misura per i tuoi progetti. Dopotutto, nel mondo in rapida evoluzione dell’intelligenza artificiale, l’hardware giusto non è solo uno strumento, rappresenta il tuo vantaggio competitivo.

Scegliere la migliore GPU

TL;DR Fatti principali:

- Le GPU sono essenziali per l’esecuzione locale di modelli di intelligenza artificiale grazie alle loro capacità di elaborazione parallela, che superano le prestazioni delle CPU per attività di intelligenza artificiale complesse.

- La scelta della GPU dipende dal budget e dalla complessità del modello, con opzioni che vanno da GPU convenienti come RTX 3060 a modelli di fascia alta come RTX 5090, ciascuno dei quali offre diversi livelli di VRAM e potenza di calcolo.

- I fattori chiave di prestazione da considerare includono VRAM, potenza di calcolo, larghezza di banda della memoria e tecniche come la quantizzazione, che possono ottimizzare l’utilizzo delle risorse ma incidere sulla precisione.

- Il noleggio di GPU cloud è un’opzione conveniente per progetti a breve termine, ma le GPU locali sono più adatte per l’uso a lungo termine e per applicazioni sensibili ai dati.

- Le tendenze future enfatizzano il bilanciamento dell’efficienza in termini di costi con la scalabilità, i rischi di utilizzo della GPU e le prestazioni, garantendo la preparazione per l’evoluzione dei carichi di lavoro AI e dei requisiti di privacy.

Perché le GPU sono necessarie per l’intelligenza artificiale?

Le CPU sono progettate per eccellere nell’elaborazione generica e nella gestione di attività sequenziali. Tuttavia, spesso hanno difficoltà con le esigenze computazionali dei grandi modelli di intelligenza artificiale a causa della loro limitata capacità di elaborare attività in parallelo. Al contrario, le GPU sono ottimizzate per l’elaborazione parallela, rendendole ideali per i carichi di lavoro AI. La loro architettura consente loro di gestire in modo efficiente le operazioni dei tensori, essenziali per l’addestramento e l’esecuzione di modelli di intelligenza artificiale.

Per i modelli di intelligenza artificiale di piccole dimensioni, le CPU possono essere sufficienti, ma con l’aumento della complessità del modello, la necessità di GPU diventa inevitabile. Le GPU consentono calcoli più rapidi, prestazioni migliori e la capacità di gestire set di dati più grandi. Senza una GPU, l’esecuzione locale di modelli IA avanzati può causare ritardi significativi o addirittura rendere impossibili alcune attività.

Opzioni GPU in tutte le fasce di prezzo

La GPU giusta per le tue esigenze di intelligenza artificiale dipende in gran parte dal tuo budget e dalla complessità dei modelli che prevedi di eseguire. Di seguito è riportata una descrizione delle opzioni GPU in diverse fasce di prezzo, evidenziandone le capacità e i limiti:

- $ 0- $ 300: GPU come GTX 1080 Ti o RTX 3060 sono convenienti e adatte a modelli più piccoli, gestendo 10 miliardi di parametri. Tuttavia, la VRAM e la potenza di calcolo limitate li rendono meno efficaci per modelli più grandi o attività più impegnative.

- $800: L’RTX 3090, con 24 GB di VRAM, è una scelta popolare tra gli appassionati di intelligenza artificiale. Raggiunge un equilibrio tra costi e prestazioni, supportando modelli con un massimo di 30 miliardi di parametri e fornendo risultati affidabili per la maggior parte dei carichi di lavoro di intelligenza artificiale.

- $ 2.000: L’RTX 4090 offre una maggiore potenza di calcolo ma solo un modesto aumento di VRAM rispetto all’RTX 3090. Sebbene offra prestazioni migliori, il suo prezzo più alto potrebbe non giustificare i vantaggi incrementali per tutti gli utenti.

- $ 3.000: L’RTX 5090, che ha 32 GB di VRAM, è progettata per modelli più grandi e attività IA avanzate. Tuttavia, il suo costo elevato può scoraggiare gli utenti occasionali, soprattutto quando molte GPU di fascia media possono ottenere risultati simili a un prezzo inferiore.

- Alternative AMD: GPU come RX7900 XTX (24 GB VRAM) offrono un’opzione conveniente per gli utenti disposti ad affrontare le sfide di compatibilità del software. La maggior parte dei framework IA sono ottimizzati per l’hardware NVIDIA, rendendo le GPU AMD meno facili da usare ma comunque utilizzabili con una corretta configurazione.

Scheda grafica per l’elaborazione AI locale

Ecco alcune guide aggiuntive dalla nostra vasta libreria di articoli che potresti trovare utili per l’esecuzione dell’IA locale.

Fattori prestazionali da considerare

Molti fattori determinano le prestazioni di una GPU nelle attività di intelligenza artificiale. Comprendere questi fattori può aiutarti a scegliere l’hardware giusto per le tue esigenze specifiche:

- VRAM: La quantità di VRAM influisce direttamente sulla capacità della GPU di gestire modelli AI di grandi dimensioni. Una VRAM insufficiente può causare colli di bottiglia nelle prestazioni o impedire del tutto l’esecuzione dei modelli.

- Potenza computazionale: Il numero di core CUDA (per GPU NVIDIA) o di unità di calcolo (per GPU AMD) influisce sulla velocità con cui la GPU può elaborare i dati. Una maggiore potenza di calcolo si traduce in prestazioni più veloci.

- Quantizzazione: Questa tecnica riduce la precisione dei parametri del modello riducendo i requisiti di risorse. Sebbene ciò possa far risparmiare VRAM e migliorare la velocità, potrebbe compromettere un po’ la precisione, rendendola difficile da prendere in considerazione.

- Larghezza di banda della memoria: La velocità con cui i dati si spostano all’interno della GPU influisce sulle prestazioni generali. Le GPU di fascia alta spesso affrontano colli di bottiglia in quest’area, limitando i loro potenziali vantaggi nonostante le loro specifiche avanzate.

Noleggio GPU cloud rispetto all’hardware locale

Per progetti AI a breve termine o utenti con budget limitati, noleggiare GPU da fornitori cloud come Lambda o Coreview può essere un’opzione pratica. I servizi cloud forniscono l’accesso a GPU ad alte prestazioni senza richiedere investimenti iniziali in hardware. Questa opzione è particolarmente utile per testare modelli o gestire carichi di lavoro temporanei.

Tuttavia, per progetti o applicazioni a lungo termine che coinvolgono dati sensibili, potrebbe essere più conveniente e sicuro investire in hardware locale. Le GPU locali forniscono un maggiore controllo sui tuoi dati ed eliminano i costi ricorrenti associati al noleggio del cloud. Quando decidi tra il noleggio del cloud e le GPU locali, considera fattori quali la durata del progetto, il budget e l’importanza della privacy dei dati.

Tendenze e idee future

La crescente domanda di privacy e personalizzazione sta stimolando l’interesse nell’esecuzione di modelli di intelligenza artificiale a livello locale. Investire oggi nelle GPU non solo supporta gli attuali carichi di lavoro AI, ma ti prepara anche per i futuri progressi nella tecnologia AI. Tuttavia, ci sono diversi compromessi che vale la pena tenere a mente:

- GPU utilizzata: L’acquisto di GPU usate, in particolare quelle precedentemente utilizzate per il mining di criptovalute, può far risparmiare denaro. Tuttavia, l’usura ha ridotto la durata di queste GPU, rendendole un investimento rischioso.

- GPU di fascia alta: Sebbene potenti, GPU di fascia alta come RTX 4090 o 5090 potrebbero non essere convenienti per gli utenti generici o per le applicazioni AI su piccola scala. Valuta le tue esigenze specifiche prima di effettuare un simile investimento.

- Scalabilità: Per progetti più grandi, l’implementazione di più GPU di fascia media può spesso fornire prestazioni migliori ed efficienza in termini di costi rispetto a fare affidamento su un’unica GPU di fascia alta. Questo approccio offre inoltre una maggiore flessibilità per ridimensionare il carico di lavoro.

Scegliere la GPU giusta implica bilanciare budget, esigenze di prestazioni e obiettivi a lungo termine. Mentre le GPU più vecchie possono gestire modelli più piccoli, i modelli più grandi e complessi richiedono hardware avanzato come RTX 3090 o RTX 4090. Per gli utenti attenti ai costi, le GPU AMD o il noleggio del cloud possono fornire opzioni praticabili. Poiché la tecnologia AI continua ad evolversi, investire oggi nell’hardware giusto ti garantisce di essere ben attrezzato per affrontare carichi di lavoro AI sempre più complessi, offrendoti flessibilità e controllo sui tuoi progetti.

Credito mediatico: Caleb scrive codice

Archiviato in: AI, Guide, Hardware

Ultime offerte di gadget Geeky

Divulgazione: Alcuni dei nostri articoli contengono link di affiliazione. Se acquisti qualcosa tramite uno di questi link, Geeky Gadgets può guadagnare una commissione di affiliazione. Scopri la nostra politica di divulgazione.