E se il successo della tua applicazione AI dipendesse da soli tre passaggi? In un mondo in cui i grandi modelli linguistici (LLM) stanno rimodellando le industrie, la capacità di valutare efficacemente le loro prestazioni è più importante che mai. Tuttavia, molti team faticano ad andare oltre vaghi benchmark o metodi di test generici, lasciando i loro sistemi vulnerabili a incoerenze e disallineamenti. La verità è che un processo di valutazione strutturato può fare la differenza tra un’intelligenza artificiale che fornisce risultati Risultati affidabili e reali E che non è all’altezza delle aspettative. Questo rapporto fornisce un quadro chiaro e attuabile per aiutarvi ad affrontare questa sfida con fiducia.

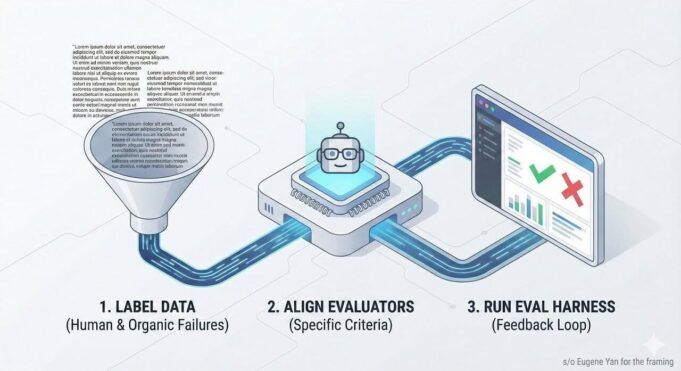

Nelle sezioni seguenti Langchen vi guida attraverso a metodo in tre fasi Progettato per semplificare la valutazione delle applicazioni IA. Dalla preparazione di un set di dati appositamente creato all’allineamento dei valutatori e alla conduzione di test iterativi, ogni passaggio è l’ultimo per garantire che il tuo sistema sia sviluppato con precisione e finalità. Che tu stia perfezionando l’output per raggiungere obiettivi stilistici o colmare le lacune prestazionali, questo processo ti fornisce gli strumenti per perfezionare la tua applicazione e adattarti alle mutevoli richieste. Alla fine, non solo capirai come valutare l’intelligenza artificiale in modo efficace, ma acquisirai anche informazioni dettagliate sulla creazione di sistemi dinamici quanto le sfide per cui sono costruiti.

Guida efficace alla valutazione LLM

TL;DR Fatti principali:

- Una valutazione efficace delle applicazioni LLM (Large Language Model) prevede un processo strutturato in tre fasi: etichettatura del set di dati, allineamento del valutatore ed esecuzione di test iterativi.

- La creazione di un set di dati appositamente creato con criteri di etichettatura chiari garantisce che il processo di valutazione sia in linea con obiettivi specifici e definisca un successo misurabile per l’applicazione.

- Allineare il valutatore LLM con criteri definiti aiuta a perfezionare l’output per soddisfare le aspettative stilistiche, tonali e funzionali, che richiedono un costante aggiustamento in base alle esigenze.

- I test iterativi con l’imbracatura di valutazione consentono un miglioramento continuo identificando anomalie, espandendo il set di dati e perfezionando le prestazioni del sistema nel tempo.

- L’adattamento e l’iterazione sono necessari per adattare il processo di valutazione ai requisiti applicativi unici, garantendo risultati affidabili e di alta qualità su misura per le richieste del mondo reale.

Passaggio 1: etichetta un set di dati piccolo e appositamente creato

La base di qualsiasi processo di valutazione efficace inizia con la creazione di un set di dati che rifletta il tuo caso d’uso specifico. Ad esempio, se il tuo obiettivo è trasformare i post lunghi del blog in tweet concisi e professionali, il tuo set di dati dovrebbe includere esempi sia dell’input (contenuti di lunga durata) che dell’output desiderato (tweet brevi e raffinati). Etichetta questo set di dati con criteri chiari e binari, come “superato” o “fallito”, per determinare se l’output soddisfa le tue aspettative.

Perché è necessario questo passaggio?

- Ciò stabilisce una definizione chiara e misurabile di successo per la tua applicazione.

- Ciò garantisce che il processo di valutazione sia direttamente legato ai tuoi obiettivi e alle tue esigenze specifiche.

- Ciò evita di fare affidamento su standard di valutazione generici o eccessivamente ampi che potrebbero non soddisfare le tue esigenze.

Ad esempio, se mantenere un tono professionale è una priorità, i criteri di etichettatura dovrebbero riflettere chiaramente questa esigenza. Creando etichette accurate e mirate, si gettano solide basi per il processo di valutazione, garantendo che i passaggi successivi siano mirati ed efficaci.

Passaggio 2: allineare il valutatore LLM

Dopo aver etichettato il set di dati, il passaggio successivo è allineare il valutatore LLM ai criteri definiti. Ciò comporta la formazione del valutatore per identificare e dare priorità ai risultati delineati. In questa fase possono verificarsi disallineamenti, ma possono essere risolti attraverso un attento perfezionamento e iterazione.

Come è possibile ottenere l’allineamento?

- Se il valutatore produce risultati che sembrano eccessivamente promozionali o artificiali, adeguare i criteri di valutazione per scoraggiare tali risultati.

- Se i risultati non soddisfano le linee guida stilistiche o tonali, perfeziona i parametri del valutatore per soddisfare meglio le tue aspettative.

Questo passaggio non è un’attività una tantum. Man mano che emergono nuove sfide o si evolvono le esigenze, potrebbe essere necessario ripensare e adeguare i propri criteri. L’obiettivo finale è garantire che il valutatore produca costantemente un output che soddisfi i tuoi standard, sia che ciò implichi evitare frasi simili all’intelligenza artificiale, aderire a preferenze stilistiche specifiche o mantenere un tono particolare.

Valutazione del prodotto (per applicazioni AI) in tre semplici passaggi

Dai un’occhiata ad altre guide pratiche della nostra vasta raccolta che potrebbero catturare il tuo interesse per i Large Language Models (LLM).

Passaggio 3: testare in modo iterativo con il cablaggio di valutazione

Il passaggio finale del processo di valutazione consiste nel testare il sistema utilizzando il cablaggio di valutazione. Ciò comporta l’esecuzione del prompt attraverso LLM e la valutazione dell’output in base ai criteri stabiliti. Ogni modifica, che si tratti di un nuovo segnale, di un aggiustamento del modello o di un aggiustamento dei parametri, dovrebbe essere testata per valutarne l’impatto sulle prestazioni.

Perché i test iterativi sono importanti?

- Ciò consente di identificare anomalie o carenze nell’output del sistema e risolverle immediatamente.

- Ciò offre l’opportunità di espandere il set di dati con ulteriori esempi, soprattutto se il sistema ha difficoltà con tipi specifici di input.

I circuiti di feedback svolgono un ruolo importante in questa fase. Analizzando i risultati di ciascun test è possibile individuare le aree di miglioramento e apportare modifiche mirate. Ad esempio, se le modifiche alla configurazione causano risultati incoerenti, è possibile perfezionare i segnali o riqualificare il valutatore per risolvere il problema. Questo approccio iterativo garantisce che il tuo sistema si evolva nel tempo, adattandosi ai nuovi requisiti e migliorando la sua affidabilità complessiva.

Il ruolo dell’iterazione nel miglioramento continuo

La valutazione delle domande LLM non è uno sforzo una tantum. Richiede un’iterazione costante per adattarsi alle mutevoli esigenze e migliorare le prestazioni. Man mano che la tua applicazione si evolve, potrebbe essere necessario rivedere i passaggi precedenti, come l’etichettatura di dati aggiuntivi o il perfezionamento del valutatore. Questo processo iterativo crea fiducia nella capacità del sistema di funzionare in modo affidabile in diversi scenari reali.

Personalizzazione: adattare il processo alle vostre esigenze

Ogni domanda LLM è unica e il processo di valutazione dovrebbe riflettere questa individualità. La personalizzazione è la chiave per garantire che il sistema soddisfi i tuoi obiettivi specifici. Strumenti come Langsmith possono semplificare questo processo fornendo funzionalità per l’etichettatura dei dati, l’allineamento del valutatore e il test iterativo. Questi strumenti consentono di personalizzare il processo di valutazione, facilitando il raggiungimento dei risultati desiderati mantenendo efficienza e accuratezza.

Seguendo questa metodologia strutturata in tre fasi che prevede l’etichettatura di un set di dati appositamente creato, l’allineamento dei valutatori e l’esecuzione di test iterativi, puoi valutare e perfezionare sistematicamente la tua applicazione IA. Questo approccio garantisce un miglioramento continuo, consentendo al tuo sistema di adattarsi ai requisiti emergenti e di fornire risultati affidabili e di alta qualità su misura per le tue esigenze.

Credito mediatico: Langchen

Archiviato in: AI, Notizie sulla tecnologia, Notizie principali

Ultime offerte di gadget Geeky

Divulgazione: Alcuni dei nostri articoli contengono link di affiliazione. Se acquisti qualcosa tramite uno di questi link, Geeky Gadgets può guadagnare una commissione di affiliazione. Scopri la nostra politica di divulgazione.