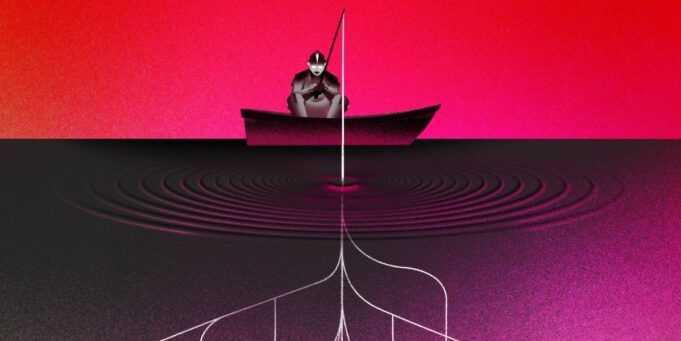

Proprio come gli ingegneri del software utilizzano l’intelligenza artificiale per scrivere codice e indagare sui bug, gli hacker utilizzano questi strumenti per ridurre il tempo e lo sforzo necessari per organizzare un attacco, abbassando le barriere che impediscono agli aggressori meno esperti di tentare qualcosa.

Alcuni nella Silicon Valley hanno avvertito che l’intelligenza artificiale è sul punto di essere in grado di sferrare attacchi completamente automatizzati. Ma la maggior parte dei ricercatori nel campo della sicurezza sostiene invece che dovremmo prestare maggiore attenzione ai rischi più immediati posti dall’intelligenza artificiale, che stanno già accelerando e aumentando il volume delle truffe.

I criminali utilizzano sempre più spesso le ultime tecnologie deepfake per impersonare persone e defraudare le vittime di ingenti somme di denaro. E dobbiamo essere preparati per ciò che accadrà dopo. Leggi la storia completa.

-Rhiannon Williams

Questo è tratto dal prossimo numero cartaceo della storia Revisione della tecnologia del MIT Magazine, che parla interamente di criminalità. Se non l’hai già fatto, Iscriviti ora Per ricevere punti futuri una volta atterrati.

Sono possibili assistenti IA sicuri?

Gli agenti IA sono un’attività rischiosa. Anche se intrappolati all’interno di una finestra di chat, gli LLM commetteranno errori e si comporteranno male. Una volta che dispongono di strumenti che possono utilizzare per interagire con il mondo esterno, come browser web e indirizzi e-mail, le conseguenze di tali errori diventano molto più gravi.

Il progetto virale dell’agente AI OpenClave, che ha fatto notizia in tutto il mondo nelle ultime settimane, consente agli utenti di creare i propri assistenti personalizzati utilizzando l’intelligenza artificiale esistente. Per alcuni utenti ciò significa consegnare moltissimi dati personali, da anni di e-mail al contenuto dei propri dischi rigidi. Gli esperti di sicurezza ne sono completamente terrorizzati.

In risposta a queste preoccupazioni, il suo creatore ha avvertito che le persone non tecniche non dovrebbero utilizzare il software. Ma c’è un chiaro appetito per ciò che offre OpenClaw, e tutte le aziende di intelligenza artificiale che sperano di entrare nel business degli assistenti personali dovranno capire come costruire un sistema che mantenga i dati degli utenti al sicuro. Per fare ciò, dovranno prendere in prestito approcci dall’avanguardia della ricerca sulla sicurezza degli agenti. Leggi la storia completa.

-Grace Huckins