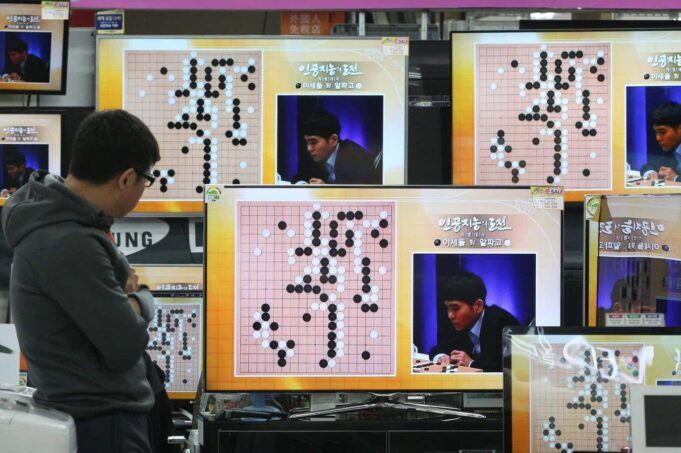

Lee Sedol affronta AlphaGo nel 2016

AP Photo/Ahn Young-joon/ Alamy

La prima volta che AlphaGo ha scatenato tutta la sua potenza, ha causato un’intensa reazione. Lee Sedol, il più grande giocatore mondiale dell’antico gioco da tavolo cinese Go, era chiaramente affascinato dal potere dell’intelligenza artificiale. La folla tranquilla nel centro di Seoul, in Corea del Sud, riusciva a malapena a trattenere il fiato. Lee e i milioni di spettatori da casa si resero presto conto che questa intelligenza artificiale era diversa da quelle precedenti.

Non stava solo picchiando Lee, ma lo stava facendo con un’efficienza quasi umana. “Alphago ha davvero un’intuizione”, ha spiegato il cofondatore di Google Sergey Brin. nuovi scienziati Nel 2016, AlphaGo è andato 3-0 poco dopo. “Fa mosse bellissime. Fa mosse ancora più belle di quanto la maggior parte di noi possa immaginare.”

La serie si è conclusa con una vittoria per 4-1 per il sistema AlphaGo di Google DeepMind. Lee ha detto che era scioccato.

È passato ormai un decennio da questo momento decisivo per AlphaGo e l’intelligenza artificiale in generale. Meravigliarsi di fronte all’intelligenza artificiale è un’esperienza comune con il successo di modelli linguistici di grandi dimensioni come ChatGPT. AlphaGo è stato, in molti sensi, il nostro primo assaggio di ciò che sarebbe successo. Dieci anni dopo, qual è l’eredità di AlphaGo e la tecnologia è stata all’altezza del suo potenziale?

“I modelli linguistici più ampi ora differiscono parecchio da AlphaGo in qualche modo, ma c’è davvero un filo tecnico sottostante che non è realmente cambiato”, afferma Chris Madison presso l’Università di Toronto, che faceva parte del team originale di AlphaGo.

Quella tecnologia di base sono le reti neurali: strutture matematiche ispirate dal cervello e scritte in codice. Storicamente, la creazione di una macchina che gioca implica che un essere umano scriva le regole che deve seguire in varie situazioni. Con le reti neurali la macchina impara da sola.

Ma anche con una rete neurale, decifrare Go era un compito difficile. L’antico gioco cinese, che vede due giocatori spostare i segnalini bianchi e neri per guadagnare territorio su un tabellone 19×19, consente 10171 Posizione possibile. In confronto, ce ne sono solo 1080 Atomi nell’intero universo osservabile.

La svolta è arrivata dal tentativo di Maddison e dei suoi colleghi di ricreare l’intuizione di un giocatore umano addestrando una rete neurale a prevedere la prossima mossa più forte sulla base di milioni di mosse provenienti da giochi reali. Naturalmente, i giocatori umani non avranno bisogno di giocare così tanti giochi per sviluppare la propria intuizione, ma non saranno mai più in grado di farlo: un netto vantaggio per l’IA.

Inoltre, AlphaGo non si limitava a imparare da giocatori umani; Può giocare milioni di partite contro se stesso per affinare le sue abilità. “Imparando attraverso questi giochi, può scoprire nuove conoscenze e superare i giocatori di livello umano”, afferma Incontra Kohli Su Google DeepMind.

Il sistema finale che sconfisse Lee era più complesso dei primi modelli di Madison, ma il messaggio generale era semplice: la rete neurale funzionava. “AlphaGo ha sicuramente dimostrato che le reti neurali possono riconoscere schemi meglio degli esseri umani. Esse possono essenzialmente avere un’intuizione migliore rispetto agli umani”, afferma Noam Brown Su OpenAI.

altri alfabeti

Quindi cosa è successo dopo? Dopo AlphaGo, Google DeepMind e i ricercatori di intelligenza artificiale sono pronti ad applicare queste lezioni fondamentali ad applicazioni del mondo reale come la matematica e la biologia. L’esempio più notevole di ciò è stato AlphaFold, un’intelligenza artificiale in grado di prevedere come apparirebbero le proteine nello spazio tridimensionale dalla loro composizione chimica, molto meglio di qualsiasi programma progettato dall’uomo, e che ha valso al team dietro di esso il Premio Nobel per la Chimica.

Più recentemente, un’altra intelligenza artificiale basata su reti neurali, AlphaProof, ha ottenuto la medaglia d’oro alle Olimpiadi internazionali della matematica, un prestigioso esame di matematica per studenti astuti matematici. “Non solo puoi ottenere un’intelligenza che va oltre il livello umano in un gioco, ma puoi anche sfruttare quell’esperienza in importanti applicazioni scientifiche”, afferma Kohli.

La logica alla base sia dello stile AlphaGo dell’intelligenza artificiale che di quella utilizzata per i modelli linguistici di grandi dimensioni (LLM) come ChatGPT è simile. Il primo passo, chiamato pre-training, prevede l’alimentazione di una rete neurale con una grande quantità di dati umani, come l’intero gioco Go o l’intera Internet nel caso di LLM. La seconda fase, chiamata post-training, migliora poi la rete attraverso una tecnica chiamata apprendimento per rinforzo, che mostra all’IA com’è il successo e le permette di capire come ottenerlo.

Per AlphaGo, questo significava permettergli di giocare contro se stesso milioni di volte finché non avesse trovato le migliori strategie vincenti. Per AlphaFold, si trattava di dire all’intelligenza artificiale come appare una proteina ripiegata con successo e lasciare che fosse lei a capire le regole. Per ChatGPT, questo significa dire al modello quali risposte le persone trovano migliori, un processo chiamato apprendimento per rinforzo dal feedback umano, o dargli una soluzione a un problema definito, come in matematica o programmazione, e lasciare che capisca come alimentare il suo output in se stesso per “ragionare” per una soluzione, in modo simile a come gli umani pensano ad alta voce.

Ma presenta anche degli svantaggi. Le reti neurali sono, per molti versi, una scatola nera. Nonostante gli sforzi per capire come funzionano, molti di essi sono così grandi e complessi che è difficile capirli a livello di base.

Quando AlphaGo fece la sua ormai famosa mossa 37, il pubblico inizialmente pensò che l’intelligenza artificiale fosse impazzita, ma man mano che il gioco procedeva, divenne chiaro che si trattava di un colpo da maestro strategico. Tuttavia, gli ingegneri di Google DeepMind non potevano chiedere ad AlphaGo perché ha fatto questa mossa, e avrebbe potuto facilmente essere un errore se non fossimo stati così perspicaci riguardo al suo ragionamento.

“Questi modelli forniranno risposte e non sapremo se si tratta di intuizioni geniali o allucinazioni”, afferma Kohli. “Stiamo tutti ancora lavorando attivamente per cercare di risolvere questo tipo di domande.”

Gran parte del successo di AlphaGo è dovuto al fatto che all’inizio c’erano molti dati per alimentare il modello e una chiara definizione di successo. Quindi, è logico che le aree in cui l’intelligenza artificiale oggi sta avendo il maggior successo siano aree in cui entrambe queste condizioni sono vere, dice Madison, come la matematica e la programmazione, dove è più facile definire e verificare cosa è vero o falso. “Le somiglianze tra questi approcci ci dicono qualcosa e ci dicono quali sono gli ingredienti essenziali per il progresso.”

Soggetto: