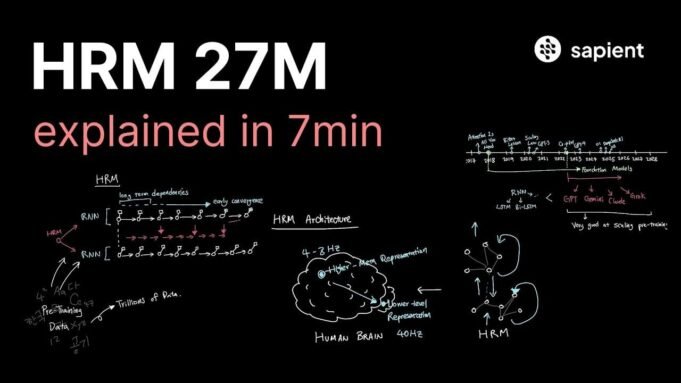

E se il futuro dell’intelligenza artificiale non fosse di dimensioni ma di semplicità? Il modello AI di HRM 27M si rappresenta una contraddizione audace, rivendicando centinaia di miliardi di parametri nel mondo dominati da modelli di trasformatore su larga scala. con solo 27 milioni di parametri-Pa una frazione della scala dei suoi rivali, HRM sfida l’idea che grande è sempre meglio. Sviluppato da Sapion Research Lab, questo nuovo modello è impiegato Architettura RNN Nerve Nerve Network (RNN) Ispirato dal cervello umano, sbloccando le abilità straordinarie nella logica e nella soluzione dei problemi senza fare affidamento sul pre-allenamento. Questo approccio minimo può ridefinire il passaggio dell’intelligenza generale artificiale (AGI)?

Kaleb scrive che il codice scopre come il design innovativo di HRM interrompe i criteri di sviluppo dell’IA, fornisce una nuova prospettiva su cosa significhi costruire sistemi intelligenti. Dalla sua architettura ispirata al cervello al rifiuto del pre-allenamento, HRM solleva domande intense sul futuro dell’abilità e della ricerca AGI. Saprai come questo modello compatto raggiunge i risultati che colpiscono ben al di sopra del loro peso, perché sfida il dominio dei sistemi basati su trasformatori e cosa significhi per il futuro dell’innovazione di intelligenza artificiale. Alla fine, puoi riconsiderare te stesso alle fondamenta dell’intelligenza sia artificiale che umana.

HRM 27m: Retenking AGI

Tl; Dr Key Takeaways:

- Il modello di AI HRM 27M sviluppato dal Sapion Research Lab nomina una doppia architettura di rete nervosa ricorrente (RNN) ispirata all’attività cerebrale umana, che sfida il dominio del modello basato sul trasformatore nella ricerca AI.

- Nonostante la dimensione compatta di 27 milioni di parametri e la mancanza di pre-allenamento, HRM mostra modelli notevoli ed efficienti nello sviluppo dell’AGI, che mostrano argomenti notevoli e risoluzioni di problemi.

- HRM funziona senza pre-allenamento, enfatizzando argomenti e problemi ricorrenti, il che sfida la dipendenza tradizionale dal set di dati e dalle risorse computazionali nella formazione dell’IA.

- Il sistema a doppio circuito del modello si ispira al modello di oscillazione cerebrale umana, ai processi rapidamente cognitivi e alla conversazione tra l’argomento intangibile lento per aumentare la soluzione dei problemi imitando l’interazione.

- L’HRM evidenzia la capacità inutilizzata dell’architettura a base di RNN come alternativa al modello di trasformatore, indicando cambiamenti nelle priorità di sviluppo dell’AGI, concentrandosi sulla logica e sull’efficienza sulla scalabilità della forza crudele.

Un approccio minimo all’innovazione dell’IA

Il design di HRM è contrario alla tendenza prevalente a segnare un modello basato su trasformatore. Fai affidamento su trasformatori principali come GPT -4 e Gemini Centinaia di miliardi o addirittura trilioni di parametriHRM ottiene risultati significativi con soli 27 milioni di parametri. Ad esempio, ha ottenuto un punteggio del 32% sul benchmark ARC AGI1 e del 2% su Arch AGI 2, che sono particolarmente notevoli, date le sue dimensioni compatte e la mancanza di pre-allenamento. Questo approccio minimo sottolinea Piccola capacità del modello abile Eseguire l’innovazione nella ricerca AGI. Concentrandosi sull’efficienza piuttosto che su un crudele potere computazionale, HRM sfida l’idea che i grandi modelli siano naturalmente migliori.

Paradigma pre-allenamento

I modelli di intelligenza artificiale tradizionali si basano troppo sul pre-allenamento, spesso elabora Tills of token Da un set di dati su larga scala per sviluppare le tue capacità. HRM, tuttavia, lavora senza imparare il pre-allenamento o il trasferimento, segnando una significativa allontanamento da questo paradigma. Invece, sottolinea Argomenti e problemi di ricorrenzaDimostrare che l’intelligenza può emergere senza l’esposizione completa dei dati. Questo approccio suggerisce che i futuri sistemi di intelligenza artificiale possono essere progettati e formati con maggiore efficienza, il che può ridurre il requisito di enormi risorse computazionali. HRM apre la porta dimostrando che il pre-allenamento non è il pieno bisogno di ottenere risultati significativi Modi alternativi per sviluppare il sistema di intelligenza artificiale,

Panoramica del modello AI HRM 27M

Passa le tue abilità Modello AI Leggendo di più il nostro materiale dettagliato.

Cervello umano

L’innovazione di HRM è nel suo cuore Doppio sistema di loop ricorrenteChe sta modellando il modello di ingrediente del cervello umano, in particolare le onde Thea e gamma. Imita l’interazione tra architettura Procedure cognitive più veloci e di livello inferiore E Argomento lento e astrattoIl modello consente di impegnarsi in cicli di analisi di ricorrenza. Il sistema a doppio ciclo non solo migliora la capacità di risolvere il problema, ma affronta anche sfide di lunga data in RNN, come la difficoltà a mantenere la convergenza precoce e la dipendenza a lungo termine. Introduci la risorsa Approccio nuovo per l’architettura AI Questa pura priorità ai processi cognitivi su scala computazionale.

RNNS vs. modello di trasformatore: una nuova prospettiva

Il modello di trasformatore ha dominato la ricerca dell’IA a causa della sua scalabilità e capacità di normalizzare in diversi compiti. Tuttavia, spesso lottano con i compiti che richiedono Argomenta profonda e comprensione pertinenteIl successo di HRM ha messo in evidenza Capacità inutilizzata dell’architettura con sede a RNN Per affrontare questi confini. L’HRM offre un’opzione avvincente alla vista incentrata sul trasformatore, preferendo problemi logici e di ricorrenza sulla scalabilità crudele. Questo cambiamento di focus può portare allo sviluppo di sistemi di intelligenza artificiale non solo più efficienti, ma anche più allineati con processi cognitivi come gli esseri umani.

Affrontare le sfide nell’architettura con sede a RNN

Nonostante i suoi risultati, l’approccio di HRM non è privo di sfide. RNN ha affrontato difficoltà nel mantenere storicamente Dipendenza a lungo termineE la loro ricorrenza può comportare disabilità computazionali a seguito della natura. Inoltre, l’assenza di pre-allenamento, mentre in alcuni casi, limita la capacità del modello di normalizzare in una vasta gamma di compiti. Affrontare queste sfide sarà necessario per perseguire l’architettura basata su RNN e garantire la loro redditività nella ricerca AGI. Può concentrarsi sullo sviluppo futuro Miglioramento E migliorare la capacità del modello di gestire compiti diversi e complessi.

Spostare le priorità nello sviluppo AGI

Il successo di HRM indica un possibile cambiamento nelle priorità della ricerca AGI. Invece di concentrarsi sul modello di trasformatore di ridimensionamento, i ricercatori possono rilevare rapidamente. Architettura alternativa ispirata alla cognizione umanaHRM indica che i modelli piccoli e più specifici possono ottenere progressi significativi nell’AGI sottolineando il meccanismo logico e di apprendimento sul potere computazionale. Questo cambiamento può aprire la strada allo sviluppo del sistema AI che non è solo più efficiente, ma anche più capace. UmiliaSfidando gli approcci tradizionali, HRM incoraggia la diffusa scoperta di ciò che è possibile nello sviluppo dell’AGI.

Credito mediatico: Scrive il codice nero

Archiviato sotto: AI, notizie migliori

Ultime offerte di gadget geek

Divulgazione: Alcuni dei nostri articoli includono collegamenti associati. Se acquisti qualcosa attraverso uno di questi link, il gadget geek può guadagnare una commissione affiliata. Scopri la nostra politica di divulgazione.