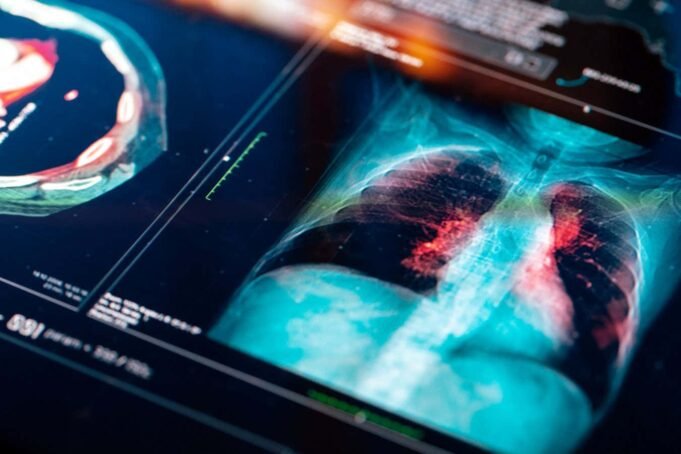

I modelli AI possono avere difficoltà a comprendere la didascalia su alcune immagini mediche

Le immagini Getty

I bambini possono padroneggiare il significato della parola “no” rapidamente, ma molti modelli di intelligenza artificiale lottano per farlo. Mostrano un ritmo altamente infruttuoso quando si tratta di comprendere il comando che contiene parole negative come “no” e “no”.

Ciò può significare che i modelli di AI medica non riescono a sentire che esiste una grande differenza tra un’immagine a raggi X, mostrata come “segni di polmonite” e uno è stato etichettato come “nessun segnale di polmonite”-poiché un medico si basa davvero sull’IA con una probabile devastazione …