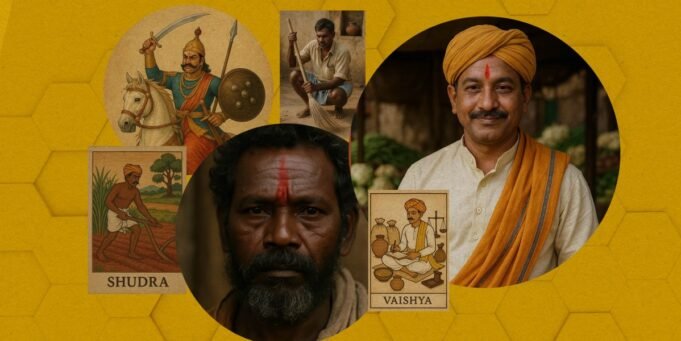

Secondo il controllo della revisione della tecnologia del MIT, il pregiudizio di casta, incluso CATGPT, è feroce nei prodotti Cateai. Sebbene il CEO Sam Altman abbia affermato di essere il secondo più grande mercato dell’India durante il lancio di GPT-5 in agosto, abbiamo scoperto che sia questo nuovo modello, che ora Pates, è il generatore di testo a video, espone casta di Sora, generatore di testo a video di Openi, mostra. Ciò riflette idee discriminatorie in modi che stanno attualmente vengono sbattuti con le palpebre.

Nel modello AI, ridurre la distorsione delle caste è più pressione che mai. Nell’India contemporanea, molte persone Dalit casta sono sopravvissute alla povertà e sono diventate mediche, funzionari e studiosi del servizio civile; Alcuni sono aumentati per diventare il presidente dell’India. Ma i modelli AI continuano a riprodurre stereotipi socio -economici e commerciali che presentano Dalit come sporchi, poveri e fanno solo un lavoro mensile. Leggi la storia completa.

– Nilesh Christopher

Audizione di revisione della tecnologia MIT: in che modo i video dei modelli di AI generano video?

Questo video è stato un grande anno per generazioni. Il lato negativo è che i produttori sono in competizione con il pendio AI e i feed dei social media sono pieni di filmati di notizie false. La generazione di video utilizza anche grandi quantità di energia, che è più di più del testo o della generazione di immagini.

Ovunque con video legati all’IA, prendiamoci un momento per parlare di un momento che li lavora.

Questa è la nostra ultima storia che deve essere convertita in MIT Technology Review, che stiamo pubblicando ogni settimana Spotify E Podcast di melaBasta navigare su MIT Technology Review, ascoltare sulla piattaforma e seguirci per ottenere tutti i nostri nuovi contenuti.

Deve legare